DeepSeek 为什么这么火?!

1 官网入口

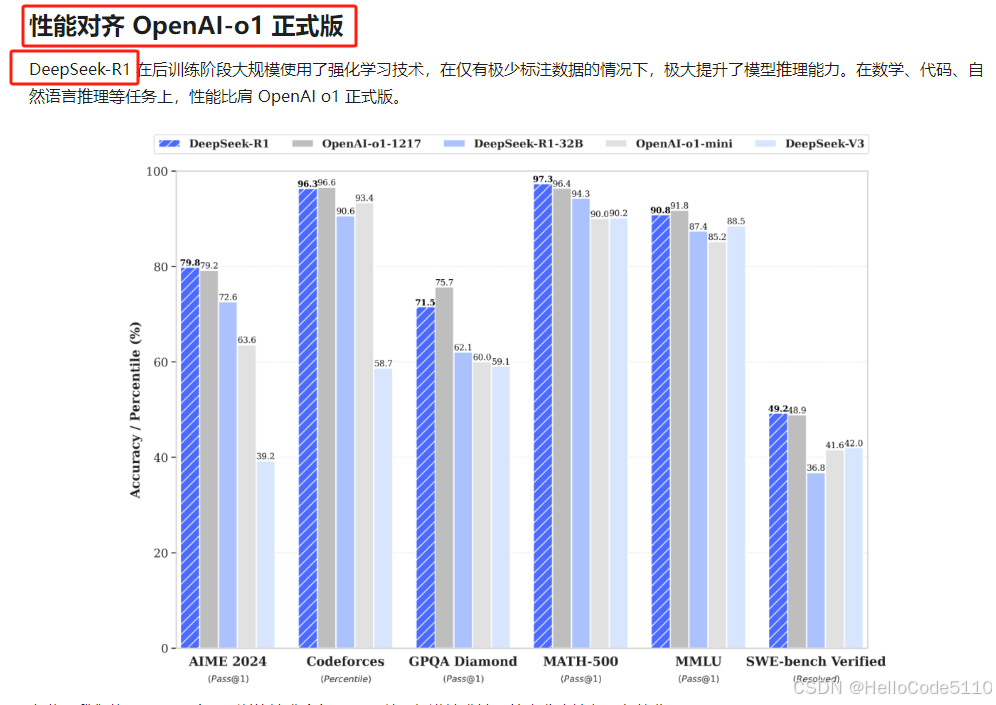

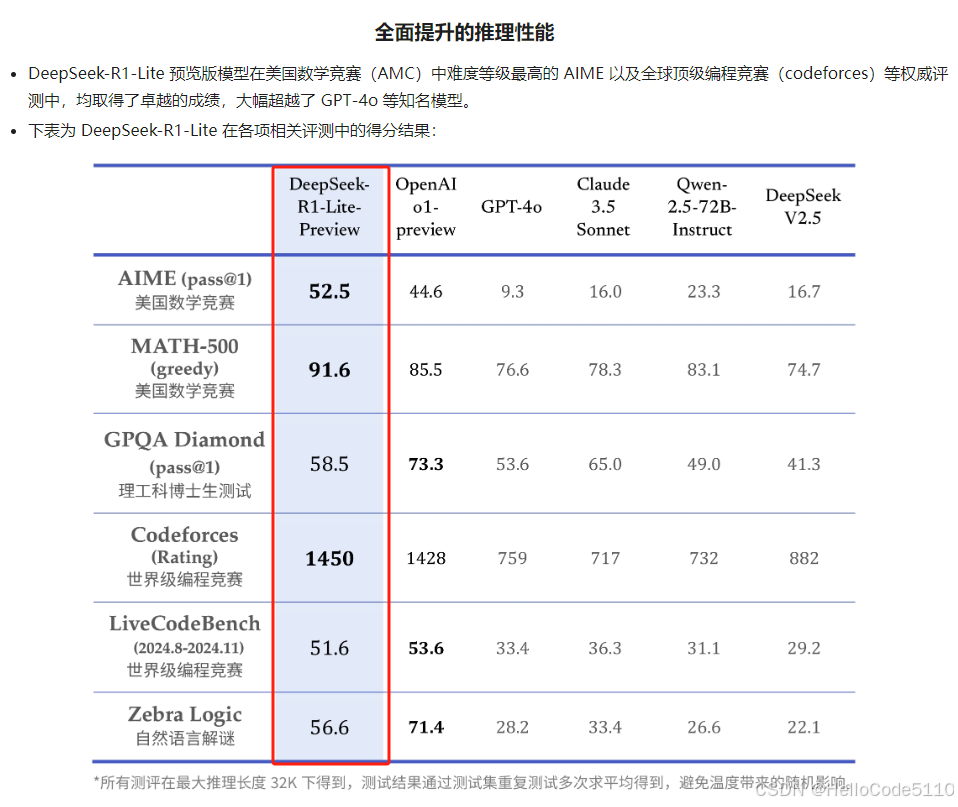

DeepSeek(价格免费)性能比肩OpenAI o1(只有尊贵的Pro用户才能使用,200美刀/月),因免费+开源+商业化,DeepSeek爆火海内外。

2 世界第一等

终端用户使用 DeepSeek 的方法

终端用户使用 DeepSeek 的方法

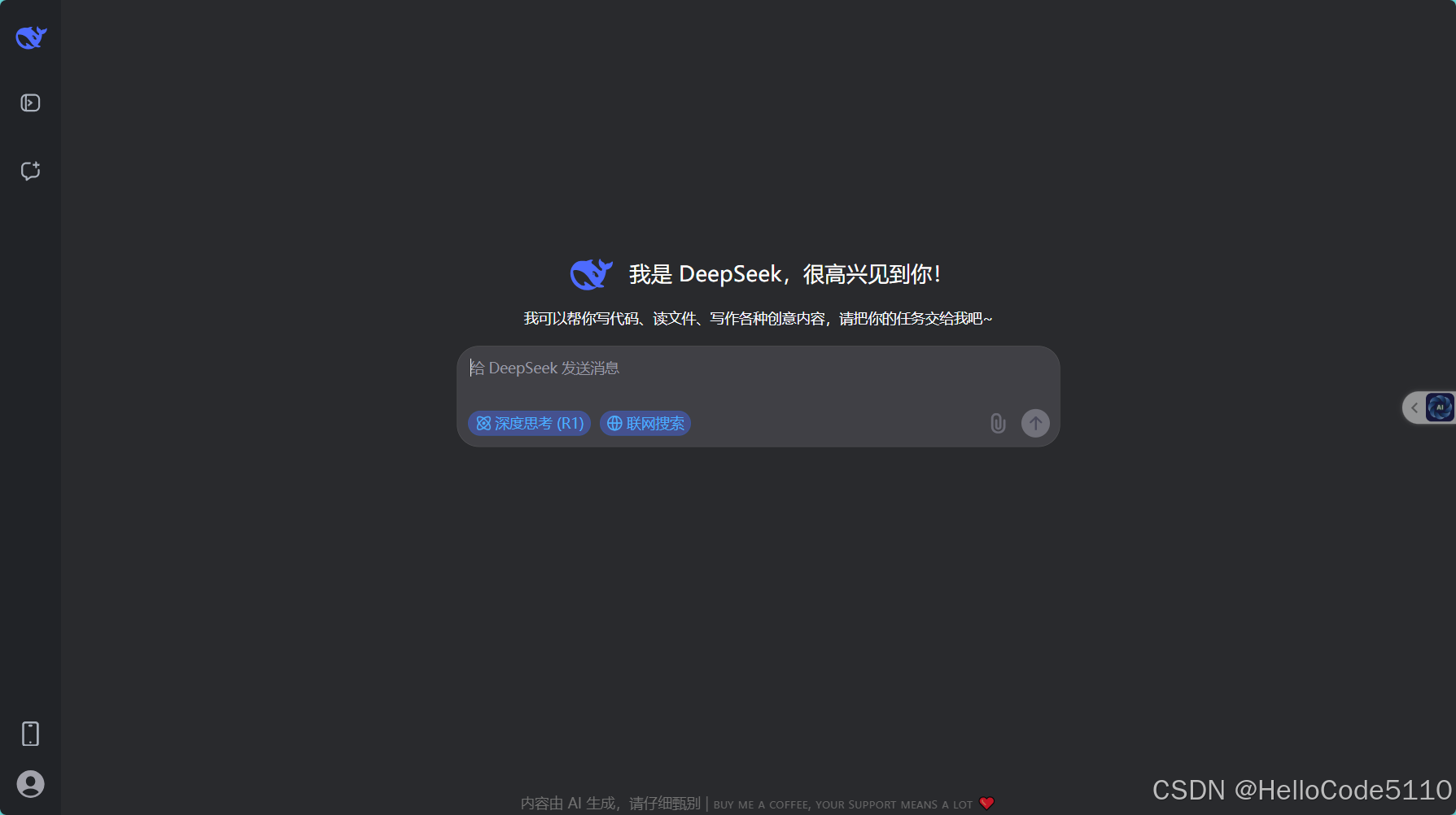

1 网页版:访问入口 https://chat.deepseek.com/

2 APP版:

官网下载 或 各大软件市场

开发者使用 DeepSeek 的方法

3 调用 DeepSeek API 方式

DeepSeek API 文档 https://api-docs.deepseek.com/zh-cn/

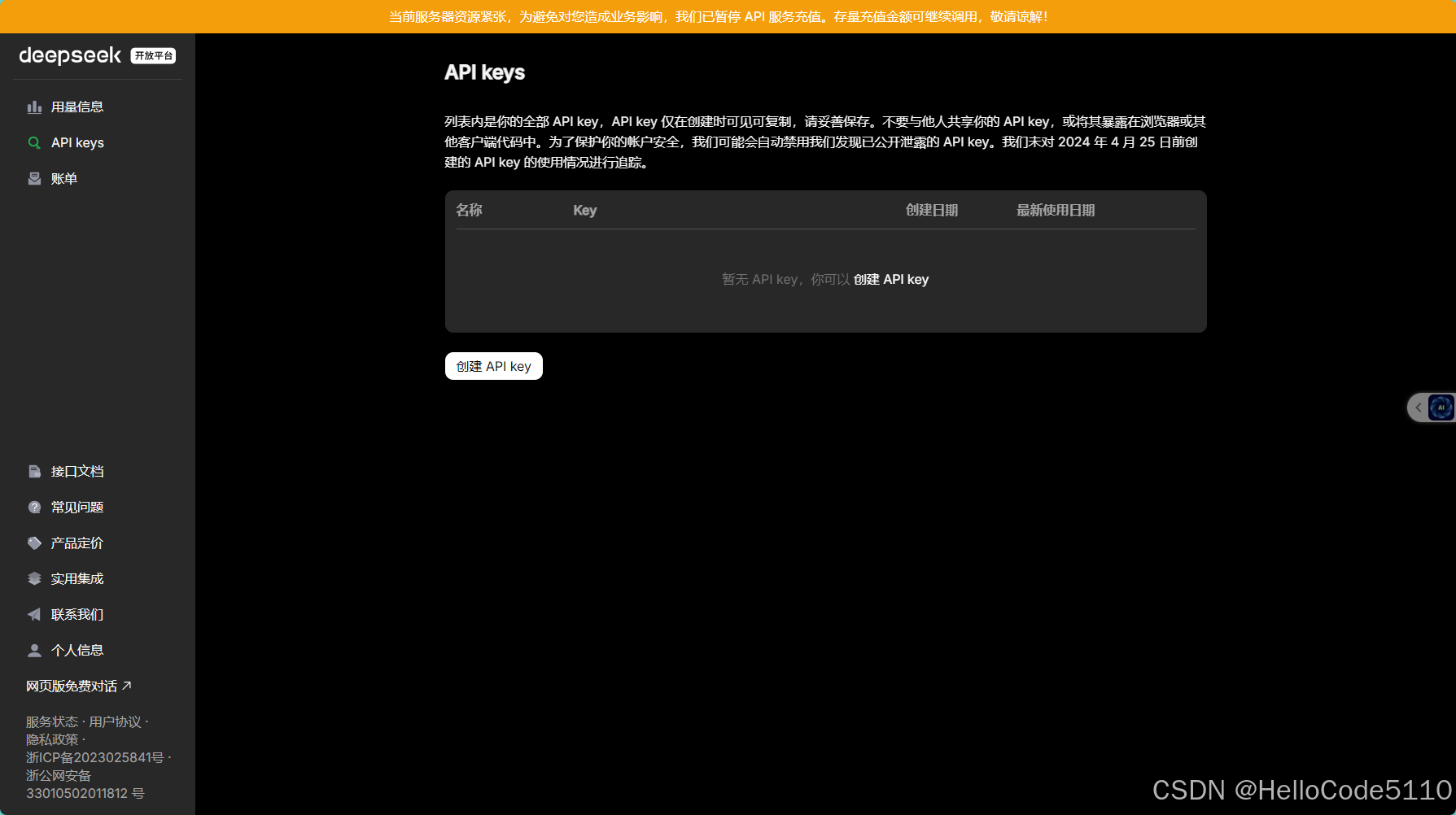

1)申请API KEY

2)Python 调用示例

注意事项:

- 模型的选用

- 是否流式响应

a. 安装依赖

pip3 install openaib. 将刚才申请好的api_key设置到代码中

- # Please install OpenAI SDK first: `pip3 install openai`

-

- from openai import OpenAI

-

- client = OpenAI(api_key="sk-e210d055226d417f8e1617e36a3260cd", base_url="https://api.deepseek.com")

-

- response = client.chat.completions.create(

- model="deepseek-chat",

- messages=[

- {"role": "system", "content": "You are a helpful assistant"},

- {"role": "user", "content": "Hello"},

- ],

- stream=False

- )

-

- print(response.choices[0].message.content)

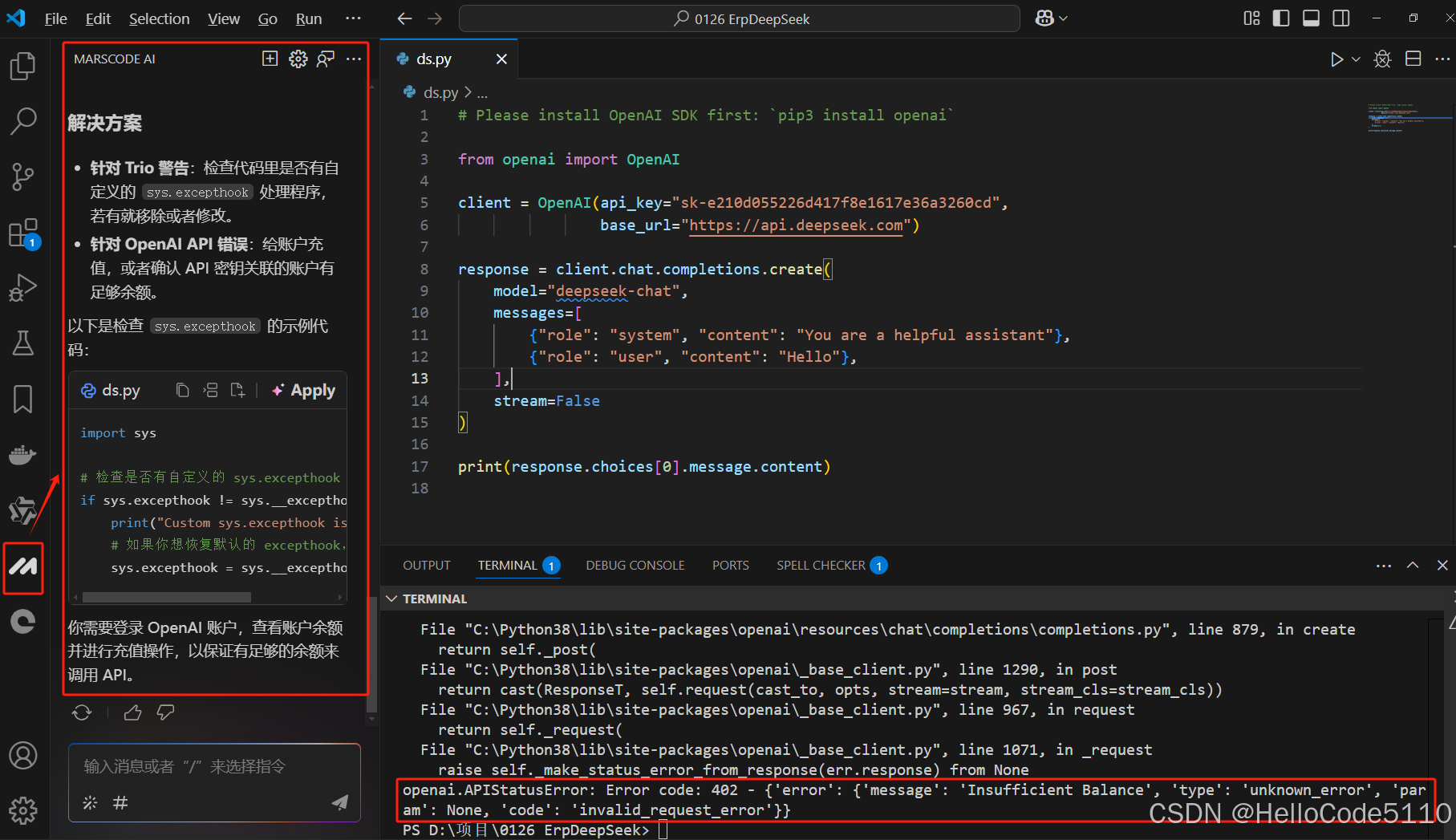

c. 运行效果

现在是报了个错,使用AI辅助工具Marscode解释下错误,它认识这个错误(表扬下Marscode!)

目前官方限制了充值,等到后面充值放开,就可以正常使用了。

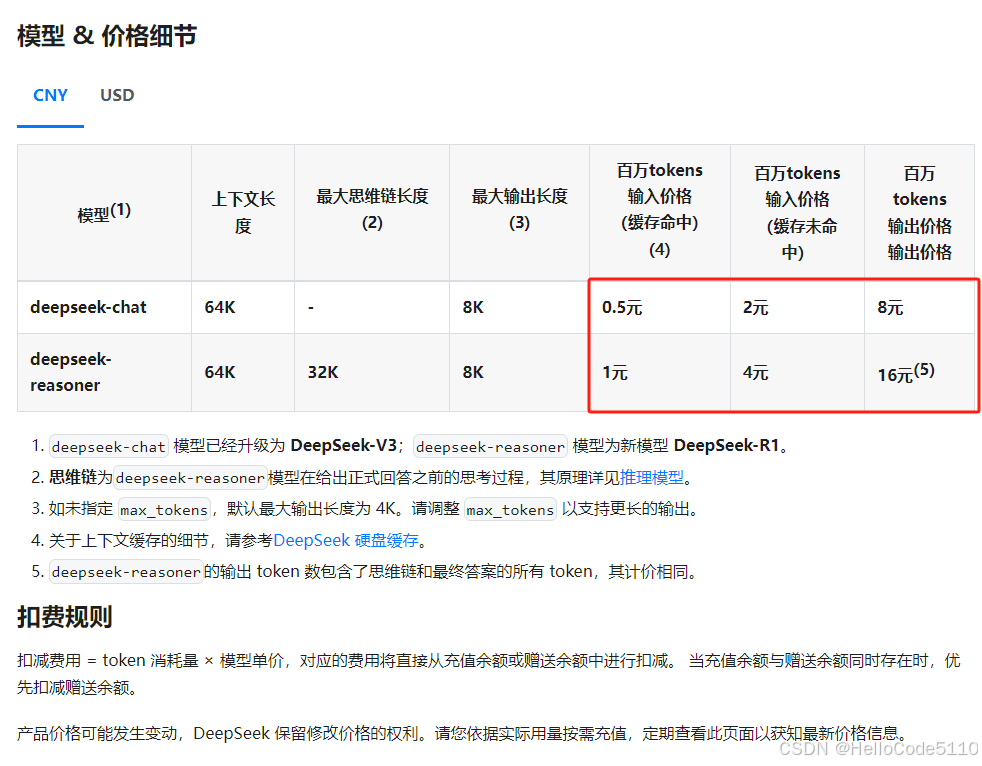

3)价格(很有竞争力)

4 DeepSeek 本地私有化部署(Ollama):

优势

- 数据安全:敏感信息(比如客户数据、商业机密),不会泄露。

- 量身定制需求:无论是行业特性还是具体任务,它都能完美适配。

- 服务稳定:响应速度更快、服务更稳定,不用担心被外部DDOS攻击。

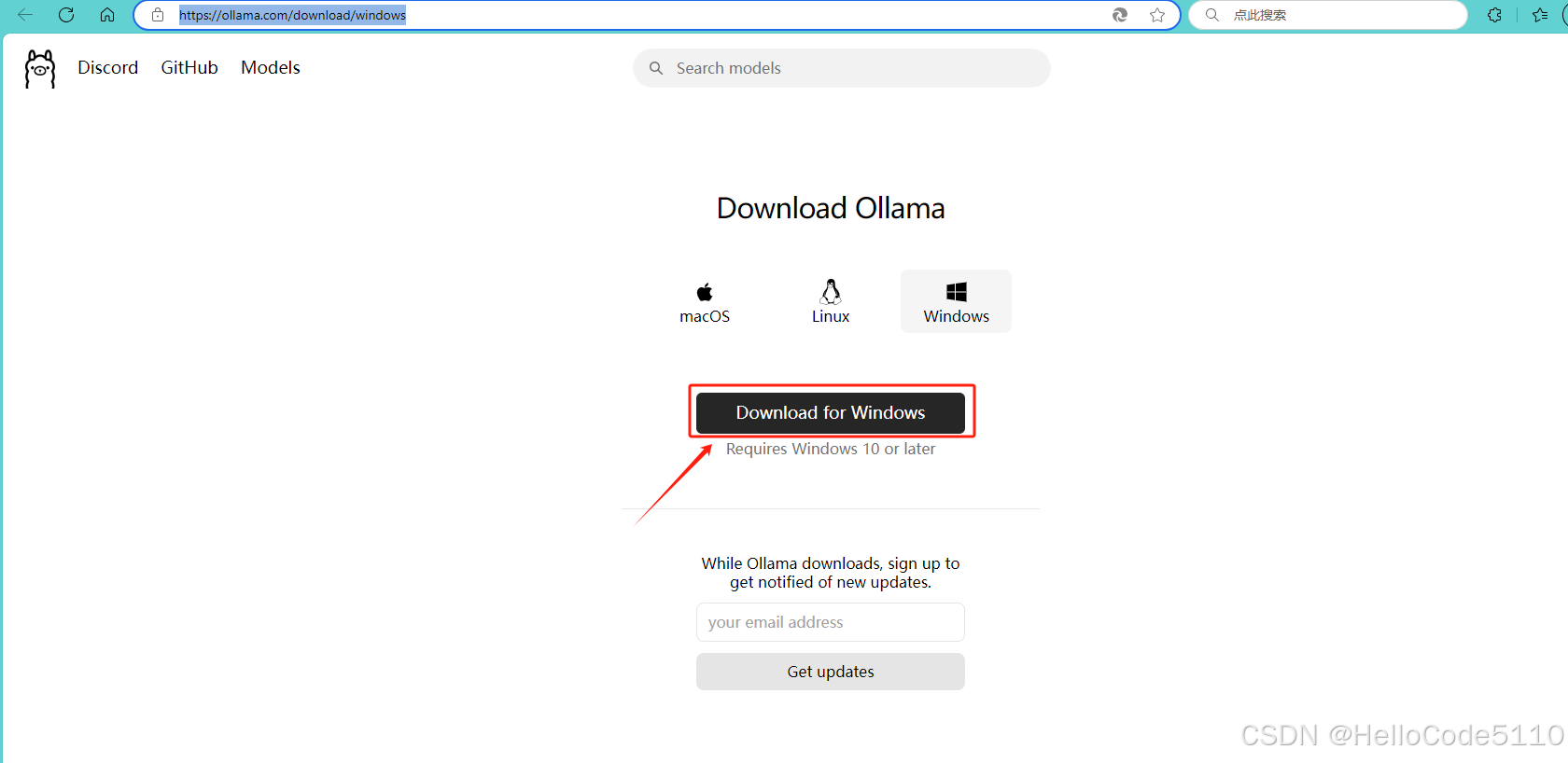

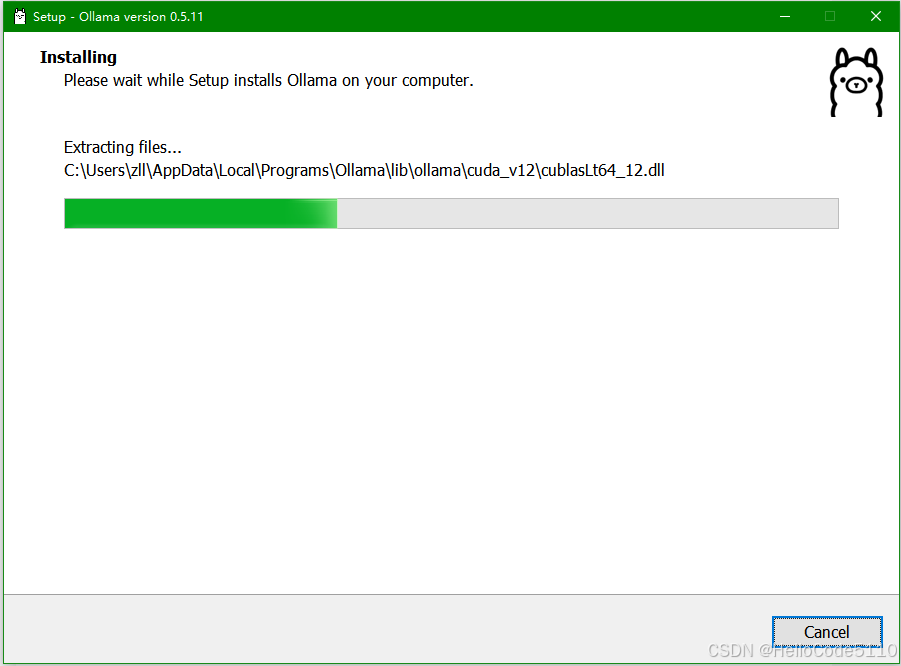

1)本地安装 ollama

a. 下载ollama: 网址 https://ollama.com/download/windows

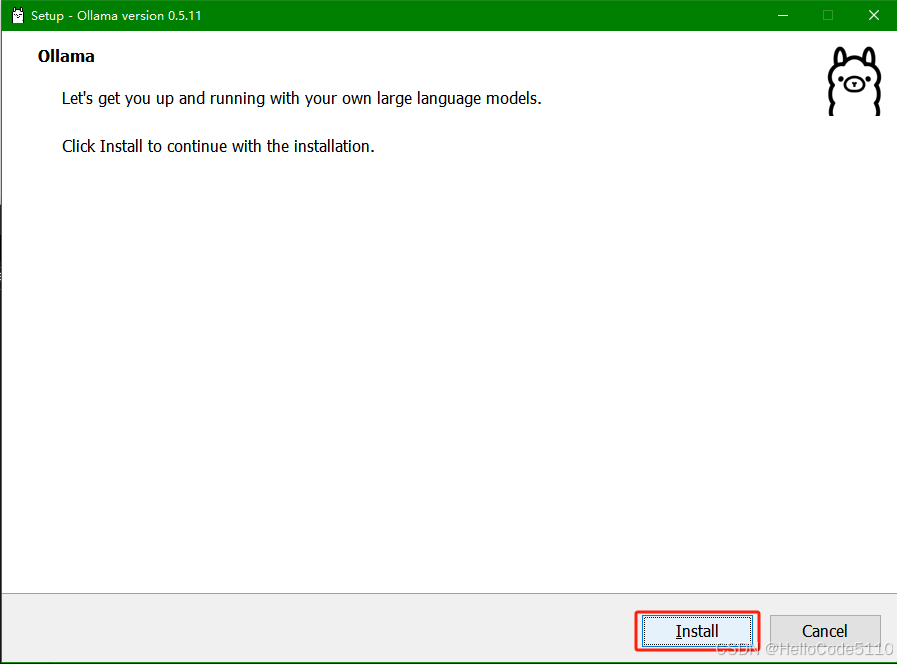

b. 安装:双击OllamaSetup.exe

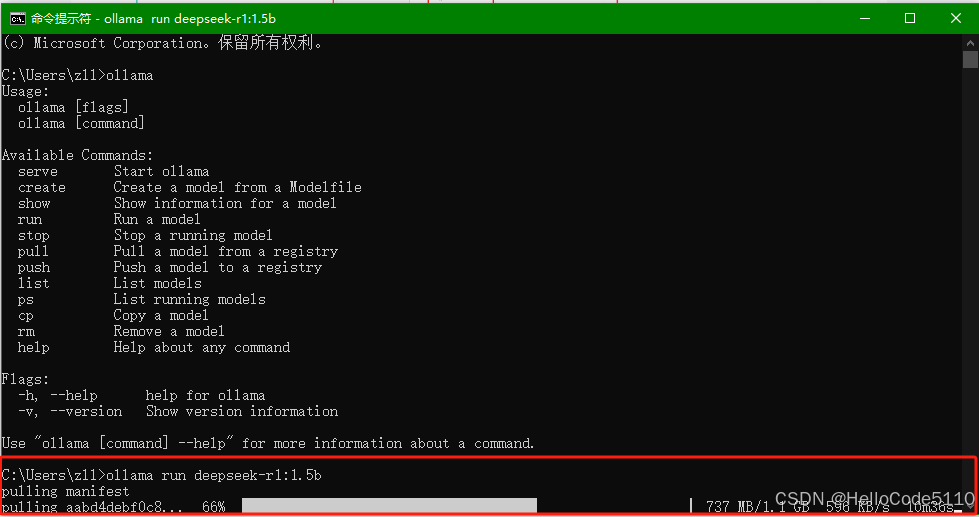

c. 检查是否安装成功:打开cmd命令行,输入ollama命令

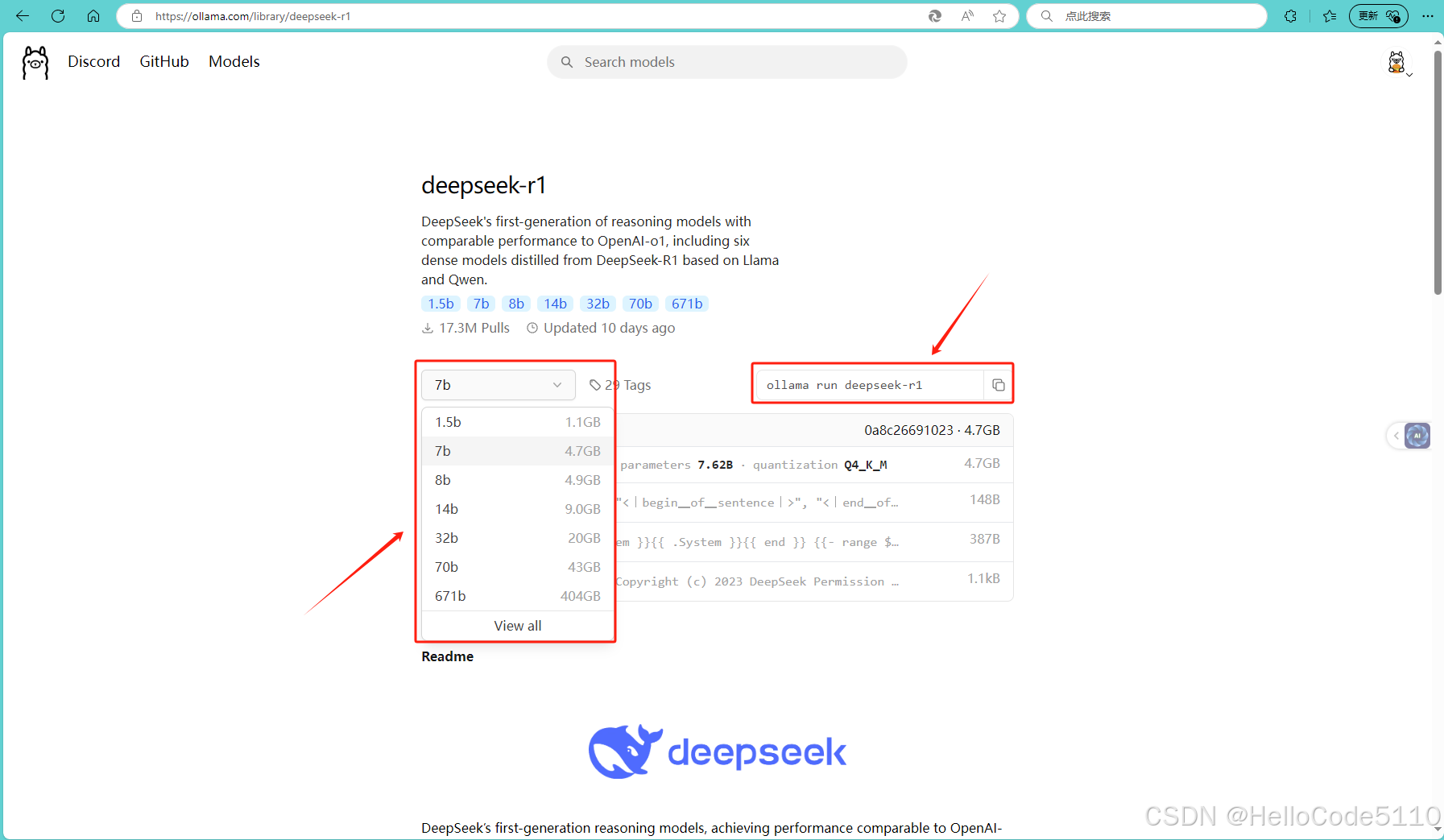

2)ollama 启动 deepseek

a. 选择合适的模型: 根据显卡显存大小

初始体验的话,选择最小版本即可

b. 启动命令

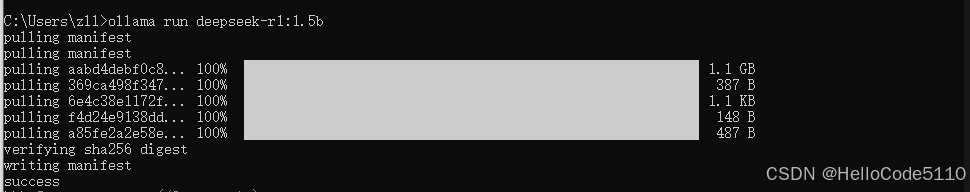

如果是首次启动,ollama会自动下载模型。

ollama run deepseek-r1:1.5bc. 模型拉取中

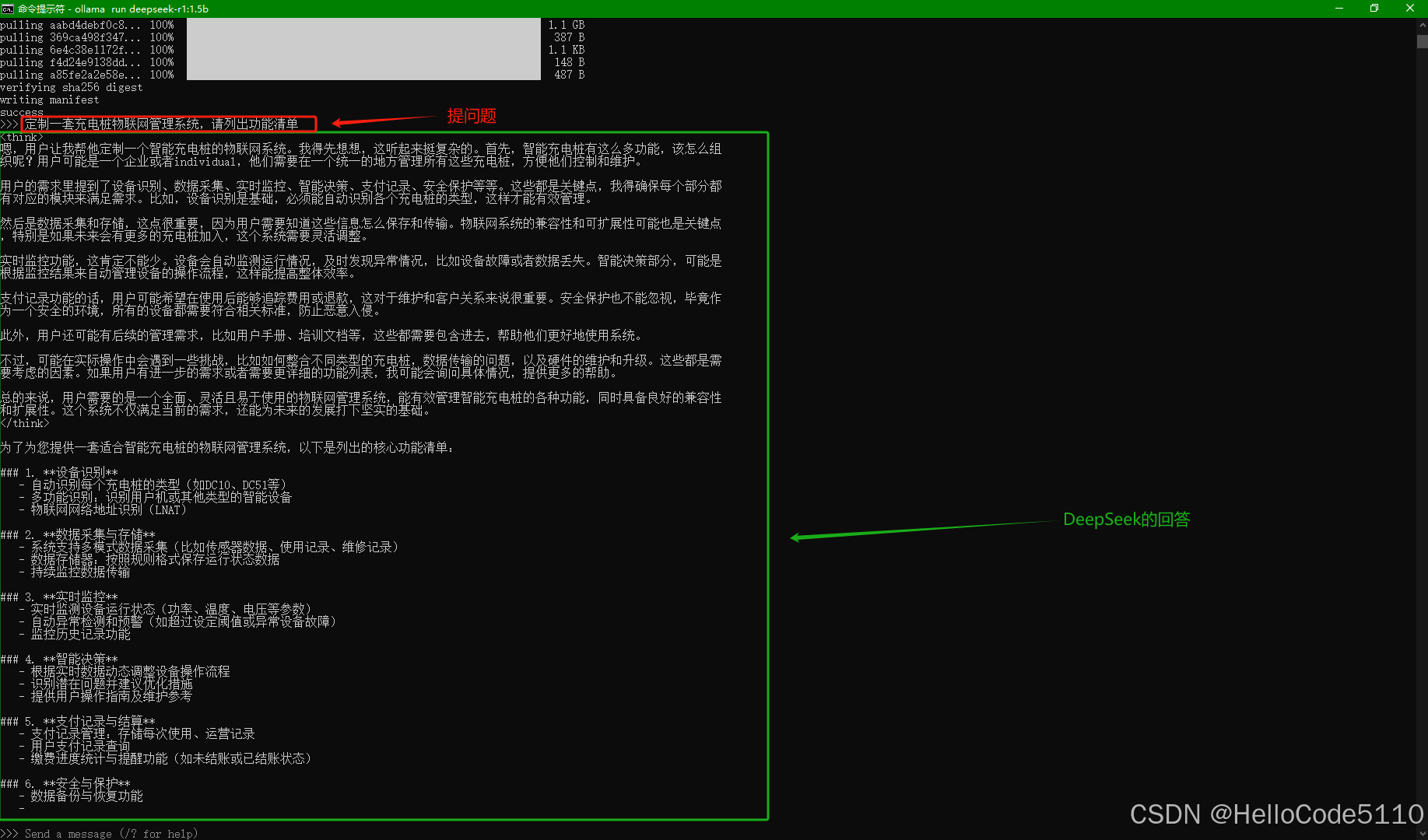

3) 服务启动OK,开始AI问答

在cmd命令窗口中,直接交互式提问响应。到这里本地部署的DeepSeek就OK了。

但是黑乎乎的命令行窗口有点丑,是不是?

要是有个美观的交互界面就好了!

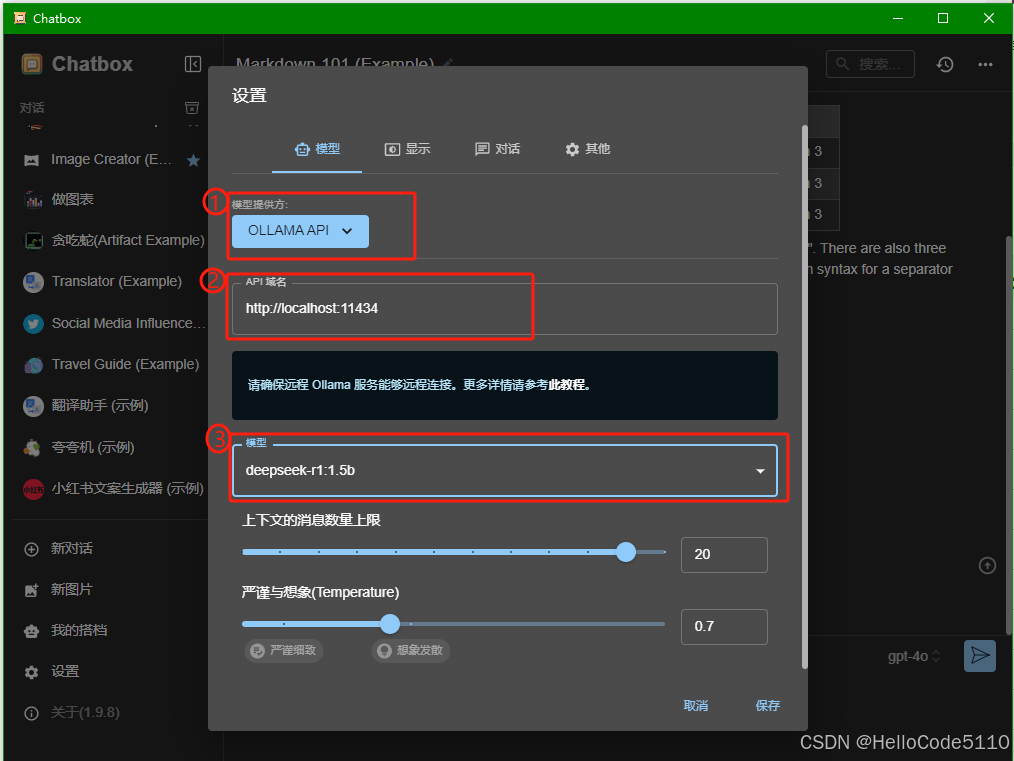

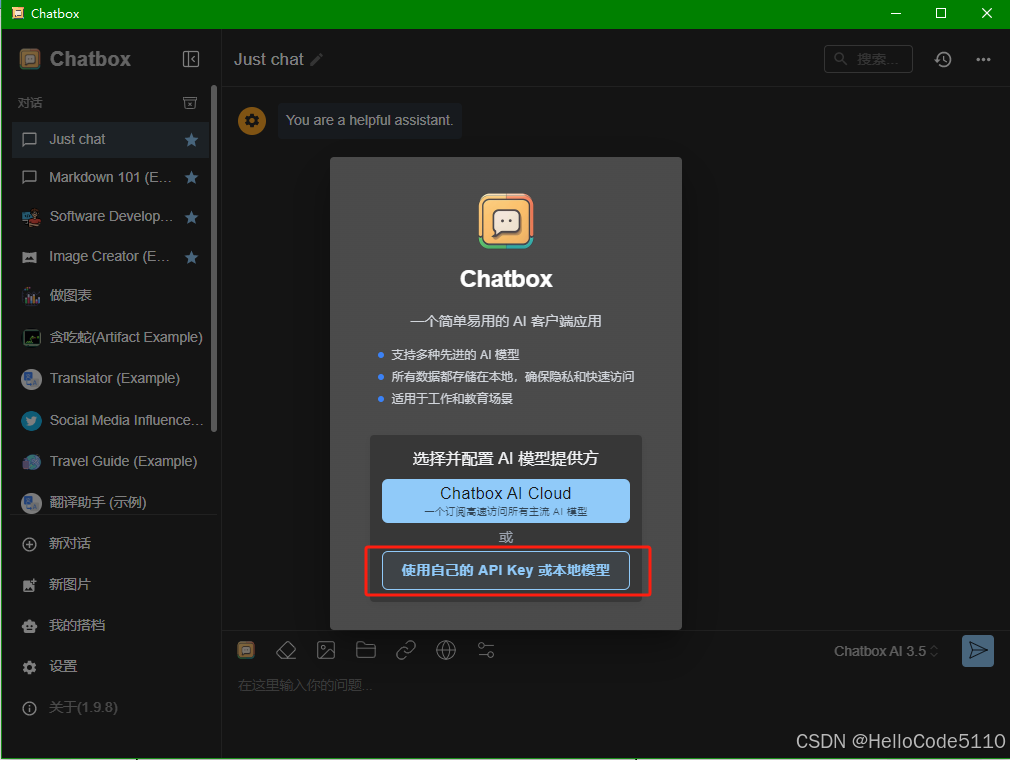

4)美化:ChatBox 美观不美观?

a.下载ChatBox

b. 安装ChatBox

c. 启动ChatBox,配置Ollama DeepSeek模型

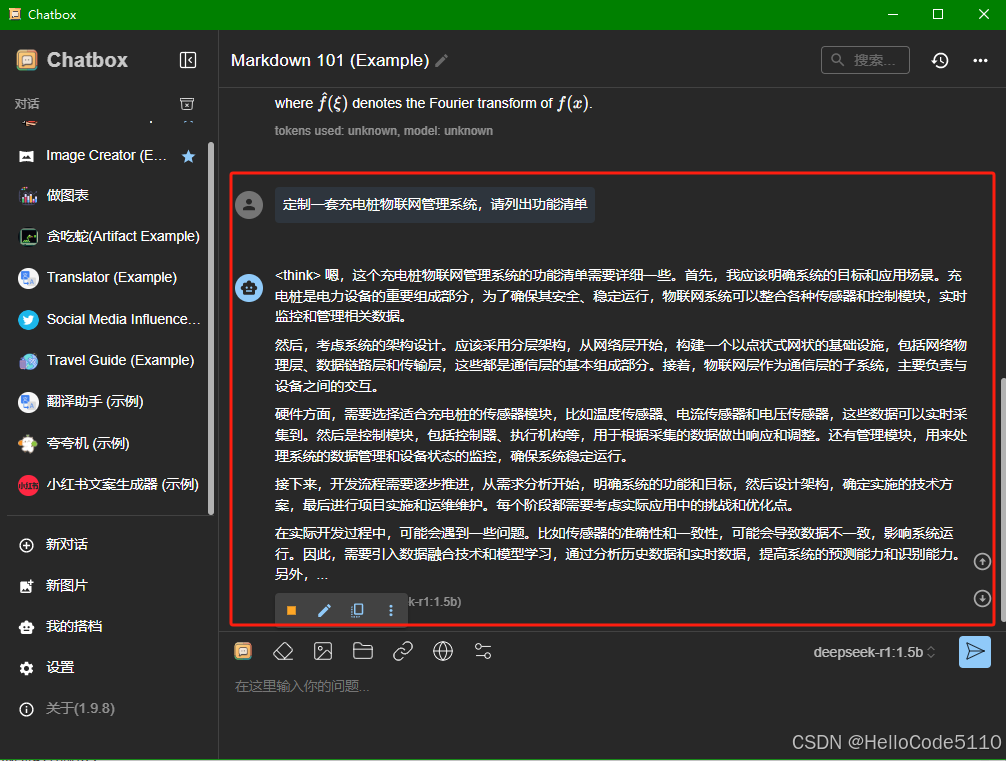

d. ChatBox 配置OK,开始AI问题

d. ChatBox 配置OK,开始AI问题

总结:使用DeepSeek的四种方法就写完了,欢迎交流,wx6550523

YYDataV系统开发

微信名片

微信名片

微信名片

微信名片

评论记录:

回复评论: