DeepSeek,可能是个国运级别的科技成果– 《黑神话:悟空》冯骥

DeepSeek 这几天可太火了,

吓到奥特曼宣布 o3-mini 免费了;

吓得英伟达市值蒸发$5890亿,把一个星际之门赔进去了。

牛到中日美澳 App Store 下载榜排名第一。太多热搜就不一一盘点了,连我奶奶都开始问我要怎么用 DeepSeek了。再加上有很多很多人来问我,啥时候能出一期 DeepSeek 的使用指南,GPT 的已经看腻了。

所以我觉得农历新年第一天应该来点大动作!让大家都丝滑用上R1。

DeepSeek 的基础使用上跟其他大模型没太大不同,网页版以对话界面为主,同时可以通过 API 接入到各种应用中。这几天我将目前衍生出来的所有玩法总结成了下面10类:

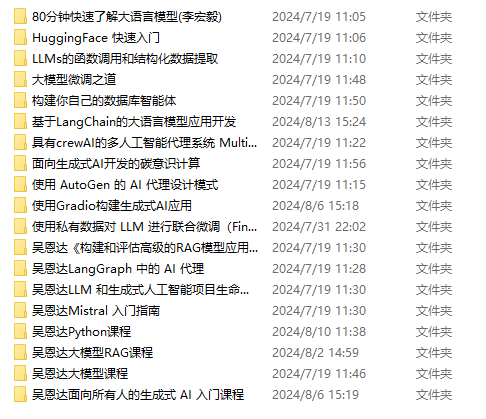

深度思考+联网搜索、多模型联动、无限制翻译、中文写作、Agent编程(Cursor穷👻套餐5.0)、电脑and手机本地运行R1推理模型、R1蒸馏模型、低成本复现R1

能用上 DeepSeek 的场景太多太多,一小段话根本概念不全,Here we go!

PS: 文章用到的所有工具都会整理到飞书文档,大家在公众号后台发我ds就行

一、基础使用

我先用一段很短的文字来科普一下 DeepSeek 的基础玩法,让阅读门槛降到最低,大家都可以分享给自己的亲朋好友。

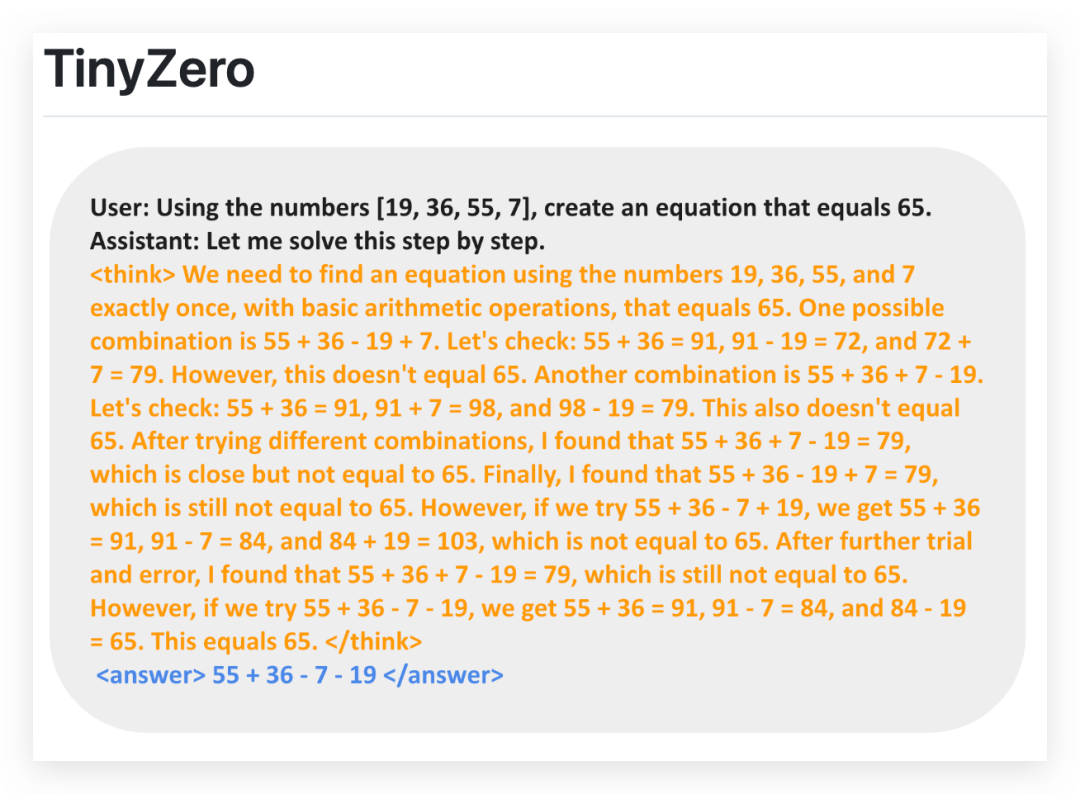

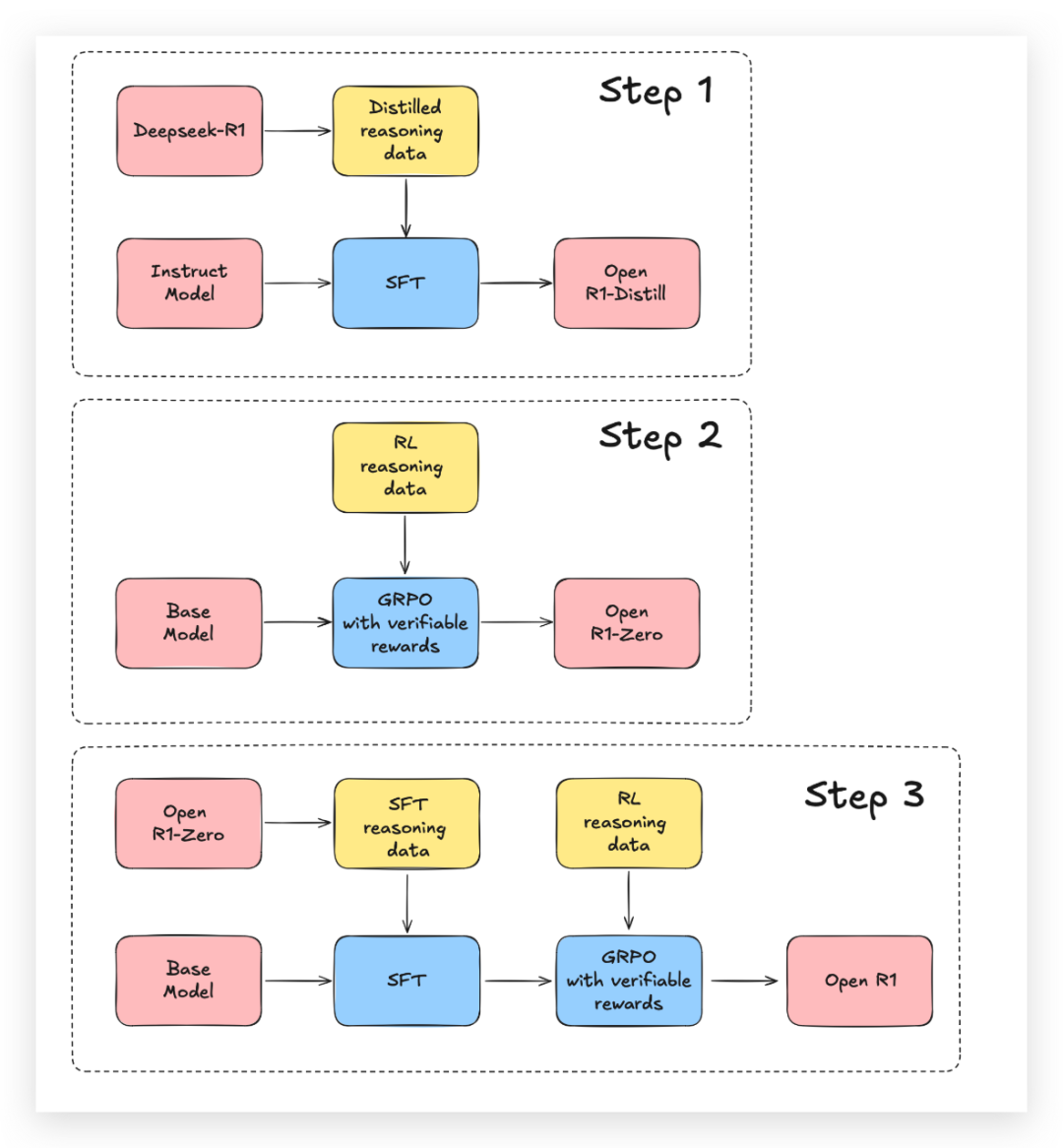

DeepSeek,也可以说这次火出圈的主要是 DeepSeek 开源版的R1,跟 OpenAI 的o1、o3一样,都属于推理模型。简单来说,推理模型跟一般的语言模型最大的不同是它们会“思考”,给出答案前先思考。就是这样一个“简单”的步骤,能给模型能力带来了很大的提升。

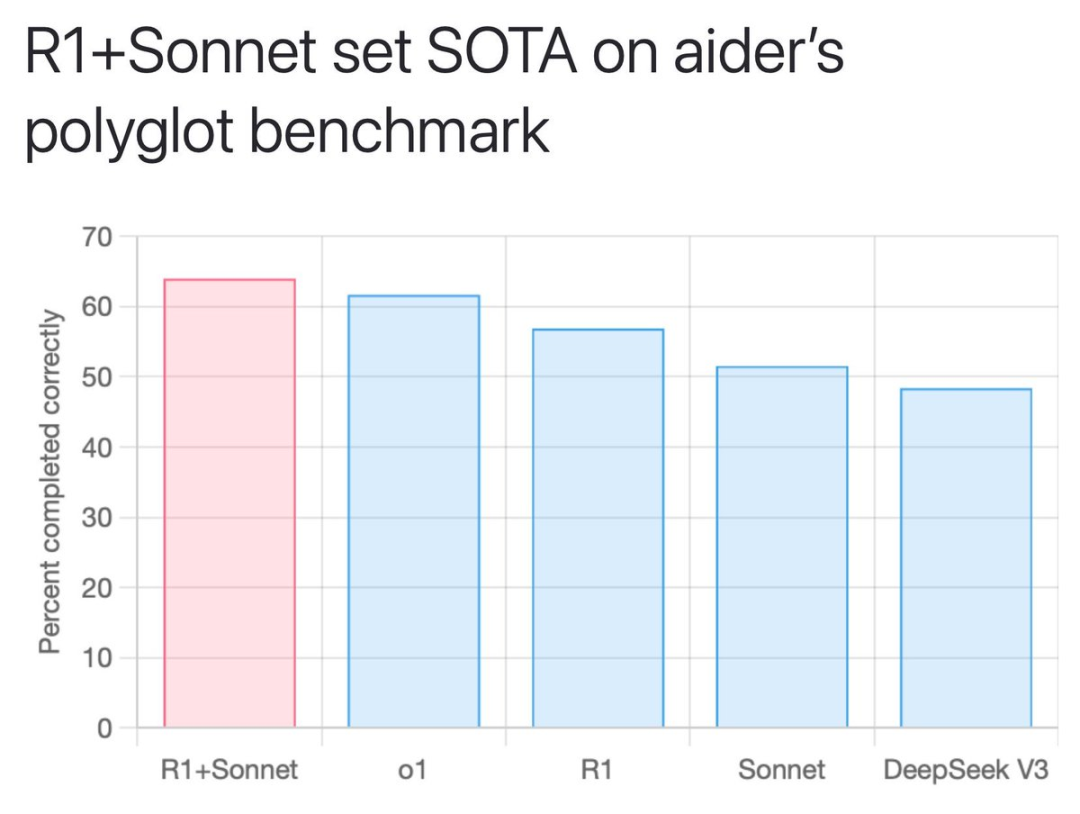

R1 不是第一个推理模型,发布的时间也不是最早的。在我看来,R1的重要意义在于便宜、开源、能跟 o1 掰手腕,还提供了一条“通天大道”!更重要的是,R1 变相揭秘了OpenAI技术细节,排除了 DPO、MCTS等模型优化概念,告诉所有人,传统的强化学习(Reinforcement learning)照样是力大砖飞,打破 OpenAI 的技术障碍。

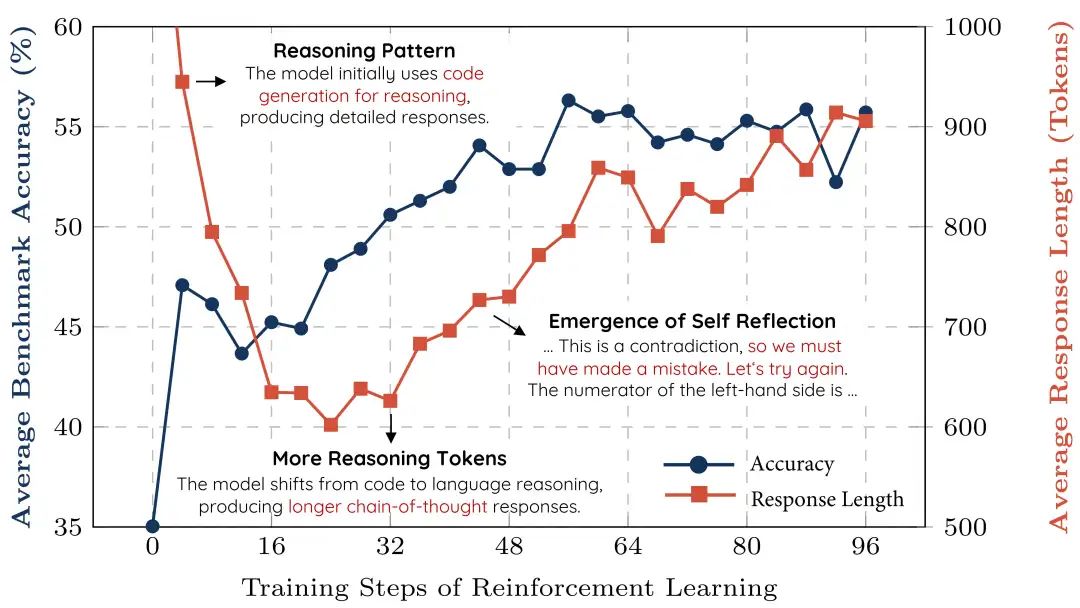

很多人关注点在于用很少的卡也能训练出效果差不多的模型,但实际上使用传统 RL 将模型提升到 o1 水平意味着其他所有人都走错了。而且 DeepSeek 还发现训练过程模型自动就能学会反思,意味在这种方法上堆更多的卡就有可能直达人工通用智能(AGI)或者超人工智能(ASI)。

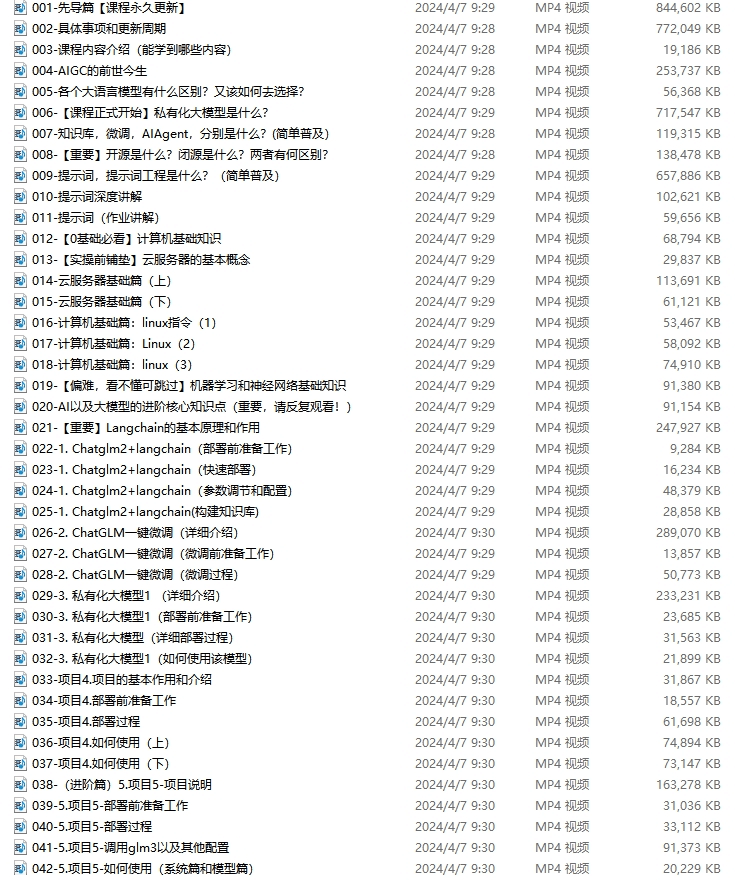

使用 DeepSeek 很简单,访问https://www.deepseek.com/

左侧是对话入口、右侧手机App、右上角是API

对话界面相当简单,我在图上就已经划分出了每个区域的功能。

DeepSeek 的 API 价格基本上是 OpenAI 的3%左右,后续在多模型联动、无限制翻译、本地运行R1推理模型等多个场景都可以接入 API,所以我这里也做了一个简单的录屏,帮助大家获取 API Key。当然视频的 API key 仅供展示,我已经作废了。

到这一步,你就已经学会 DeepSeek 的基础使用了,接下来我们马上来玩点进阶的,将 R1 的能力彻底解放出来。

二、深度思考+联网搜索

DeepSeek R1 是现阶段第一个支持联网搜索的推理模型。使用方式同样简单,在网页端同时勾选深度思考和联网搜索就行。

跟以 Preplexity 为代表的 AI 搜索不同,AI 搜索是先将复杂问题分解,然后分步骤解决问题,进而提高问答质量。**而 DeepSeek 会先进行联网搜索,然后利用 R1 进行思考,再给出答案。**

我们来测一下最简单最困难的问题:

“总结一下昨天重大的AI新闻”

不出意外,DeepSeek已经成为我的 AI 搜索Top1,没有之一。之前的联网搜索能很好解决某个专题的搜索,比如说“星际之门是什么?”、“o1是什么?”、“o1和o3有什么区别?”,但对于时间刻度来说,问10次有9次时间线都是乱的。DeepSeek 应该是也留意到这个问题了,从它的思考过程上看,R1 会反复强调信息的时效性,也就是“昨天”。同时,推理模型的优势还支持它判断这条信息应不应该纳入后续的思考过程。

三、多模型联动

这个也是最近才出现的模型玩法,号称是推理模型的正确打开方式。

多模型联动的方法论是2类模型(聊天模型、推理模型)同时使用,聊天模型(DeepSeek V3、GPT、Claude等都行)通过多轮对话来细化你想要的细节,然后将一个能满足你所有需求的提示语,发给推理模型,推理模型能一次性输出结果。

视频里我并没有用任何提示语的技巧,前后区别仅仅是将我跟聊天模型的对话后得到的上下文作为输入的一部分,一并发给 R1。这就已经可以快速得到我想要的效果。

之所以这样做,是因为跟推理模型对话最重要的是更长的上下文,最好是一个问题相关的所有上下文,通通丢进去。这时候推理模型的思考时间就体现出新的价值了。关于这个方法的细节我之前已经做过一个专题,感兴趣的可以看看。

最后简单总结一下,

「推理提示词」的目的在于引导模型如何思考;

「指令提示词」的目的在于告诉模型我要什么。

当然这个方法不局限于 DeepSeek R1,你还可以用 Grok 搜索相关的最新背景信息,然后丢给 Gemini Deep Research,在这个基础上浏览互联网上的大量信息,生成一个研究报告,最后让Claude解读和讨论这个报告。(热血组合技)!

PS:方法总结来源于:即刻-VION_WILLIAMS、即刻-Odysseys.eth、X-@karminski3

四五、无限制翻译 & 本地部署R1

从这里开始,我会同时介绍 API 和本地模型。

翻译可以说是日常使用最多的情况,我的AI翻译之路可以分为三个阶段:

-

一阶段:畏畏缩缩,API太贵,只敢选择局部段落翻译

-

二阶段:绞尽脑汁,将各家免费API聚合起来,分散压力(用 Gemini API 来翻译网页的话会因为一次性发送的请求过多被封)。

-

三阶段:免费,还能享受 DeepSeek 的中文优势。

还是先打开我们的老朋友,沉浸式翻译,它可以翻译PDF、word等文档,同时还支持翻译网站。打开设置后选择翻译服务,找到deepseek后就可以填入上面申请的 API Key。

搭配@宝玉大佬的意译提示语,

“请尊重原意,保持原有格式不变,用简体中文重写下面的内容:”

这时候翻译的内容就已经能接近人工校正后的翻译读物级别了。

接下里我要用本地模型取代API key,做到真正意义上的无限制、无费用AI翻译。(后面的代码、写作、对话等也可以用到,一鱼多吃)

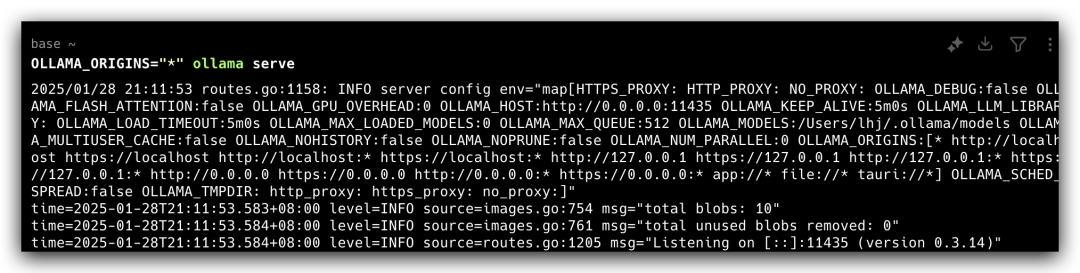

首先,我们打开 ollama,https://ollama.com/library/deepseek-r1。

按照你的电脑内存大小来选择对应的推理模型或者蒸馏模型,个人建议电脑内存在32g内,运行14b以下的模型,我电脑是 32GB 的 M1 Pro,选择了 deepseek-r1:7b 版本。

打开电脑里的任意命令行、终端后,就可以运行下面命令完成安装。(如果不知道如何打开命令行,可以带上你的电脑系统和型号,问问deepseeek😃)

## 安装命令 ollama run deepseek-r1:14b ## 安装成功后的检查命令 ollama ls ## 让沉浸式翻译能访问ollama export OLLAMA_HOST="0.0.0.0:11435" OLLAMA_ORIGINS="*" ollama serve

class="hljs-button signin active" data-title="登录复制" data-report-click="{"spm":"1001.2101.3001.4334"}">

评论记录:

回复评论: