一、背景意义

随着智能手机的普及,手机在日常生活中的使用频率大幅增加,手机检测技术逐渐成为计算机视觉领域的重要研究方向。有效识别和检测手机的应用,不仅能够提高人机交互的智能化程度,还能够在安全监控、智能支付等多个领域发挥重要作用。本项目旨在通过构建深度学习算法模型,实现对手机的高效检测,推动相关技术在实际应用中的落地。

二、数据集

2.1数据采集

数据采集是数据集制作的第一步,主要目的是收集与任务相关的样本数据。在“玩手机检测”项目中,数据采集可以通过以下几种方式进行:

-

网络爬虫:利用网络爬虫程序从互联网上自动抓取与“手机”相关的图片。选择合适的网站(如社交媒体、电子商务平台等),通过API或HTML解析获取数据。需注意遵循网站的使用条款,确保不违反版权规定。

-

公开数据集:查找现有的公共数据集,尤其是那些包含手机图像的图像数据集。例如,常用的数据集包括COCO、Open Images等,这些数据集通常已经经过标注,便于直接使用。

-

自定义拍摄:在特定场景下,自行拍摄手机图像。可以在不同的环境、光照条件以及多个品牌和型号的手机中进行拍摄,以增强数据集的多样性。

数据清洗是对采集到的数据进行筛选和处理的过程,确保数据集的质量和一致性。对于“29.玩手机检测”项目,数据清洗包括以下几个方面:

-

去除重复数据:检查数据集中是否存在重复的图像文件,删除完全相同的图片以减小数据集的冗余。

-

过滤无关图像:确保每张图像都与手机相关,去除包含其他物体或场景的图片,以避免对模型训练造成干扰。

-

图像格式转换:将所有图像转换为统一的格式(如JPEG或PNG),并调整图像尺寸,以便后续处理。可以使用Python的PIL库或OpenCV进行批量处理。

-

质量检查:对图像进行人工审核,确保清洗后数据的质量,排除模糊、过暗或过亮的图像,确保每张图像都能清晰展示手机。

2.2数据标注

数据标注是为每张图像分配标签及其位置信息的过程。这一步骤在“29.玩手机检测”项目中至关重要,通常包括以下步骤:

-

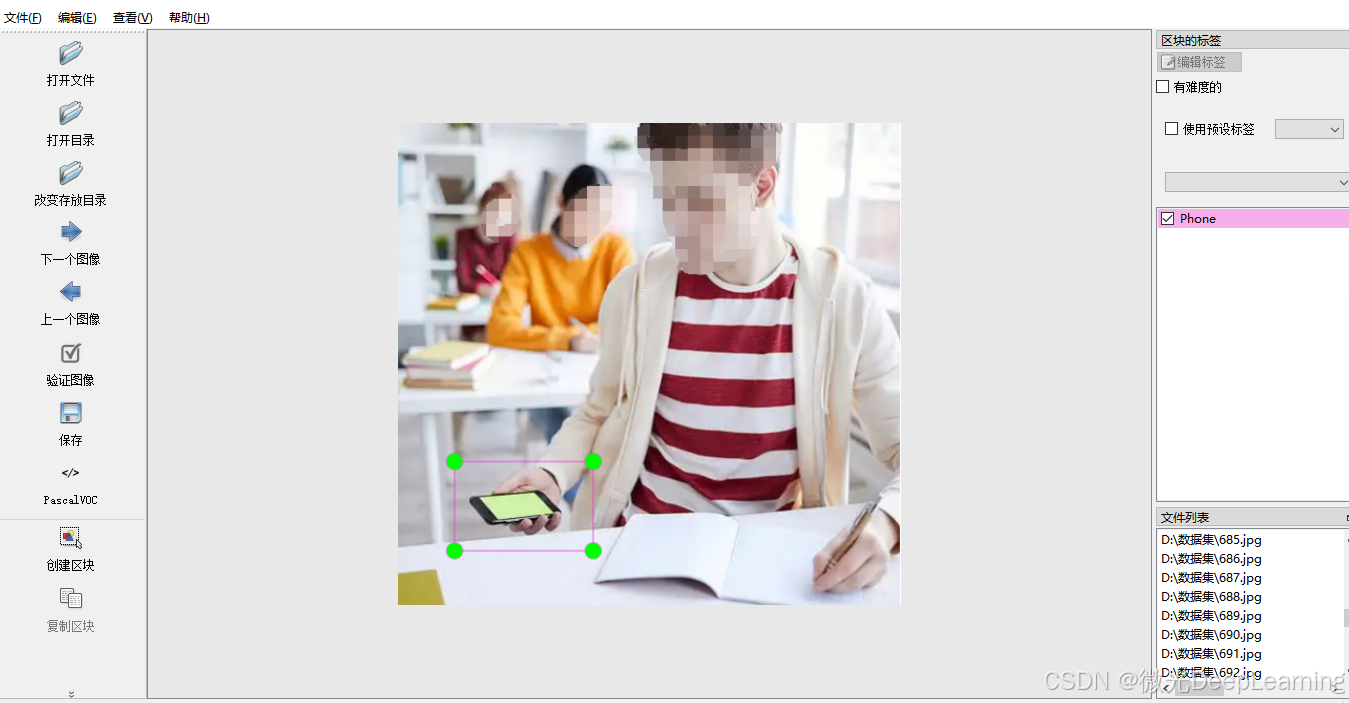

选择标注工具:选择适合的标注工具,例如LabelImg、VOTT或RectLabel等。LabelImg因其简单易用而广受欢迎,特别适合YOLO格式的标注。

-

标注类别定义:根据项目需求,在标注工具中定义类别。在此项目中,主要类别为“手机”。

-

逐张标注:使用标注工具逐张处理图像,绘制边界框并为每个框分配相应的类别。标注时需确保边界框准确覆盖手机的所有部分,避免遗漏或过度标注。

-

保存标注结果:标注完成后,保存结果为YOLO格式的文本文件,每个文件中包含相应的类别及其边界框坐标。

使用LabelImg进行数据集标注是一项复杂且耗时的工作,尤其是在处理大量图像时。首先,用户需要安装LabelImg并启动程序。在界面中,逐张打开要标注的图像,使用矩形框工具精确绘制边界框以覆盖手机,并为每个边界框指定类型(如“手机”)。每处理完一张图像,需手动保存标注结果。整个过程需要对每张图像进行仔细审核,以确保标注的准确性和一致性。在数据量较大的情况下,标注工作可能会持续数小时甚至数天,且容易受到疲劳的影响,因此需要保持高度的专注力和耐心,以确保数据集质量达到训练模型的标准。

玩手机图片数据集中包含以下几种类别:

- 手机:指人们在日常生活中使用的便携式通信设备,广泛用于信息交流、社交媒体和娱乐。

2.3数据预处理

数据预处理是将原始图像数据转换为模型可以接受的格式,以提高模型的训练效果。对于“29.玩手机检测”项目,数据预处理包括以下几个方面:

-

图像缩放:将图像缩放到统一的尺寸(如416x416或608x608),以便输入YOLO模型。缩放过程中需保持图像的纵横比,并填充背景色以防止图像失真。

-

数据增强:通过随机翻转、旋转、裁剪、颜色调整等技术,生成更多变体,以提升模型的鲁棒性。数据增强能够有效缓解过拟合问题,增强模型对多样环境的适应能力。

-

归一化处理:对图像像素值进行归一化处理,将值缩放到[0, 1]范围内,以提高模型训练的稳定性和收敛速度。

-

数据划分:根据之前的计划,将数据集划分为训练集、验证集和测试集,确保每个集中的样本数量和类别分布合理。

在使用深度学习进行训练任务时,通常需要将数据集划分为训练集、验证集和测试集。这种划分是为了评估模型的性能并确保模型的泛化能力。数据集划分为训练集、验证集和测试集的比例。常见的比例为 70% 训练集、20% 验证集和 10% 测试集,也就是7:2:1。数据集已经按照标准比例进行划分。

标注格式:

- VOC格式 (XML)

- YOLO格式 (TXT)

- yolo_dataset/

- │

- ├── train/

- │ ├── images/

- │ │ ├── image1.jpg

- │ │ ├── image2.jpg

- │ │ ├── ...

- │ │

- │ └── labels/

- │ ├── image1.txt

- │ ├── image2.txt

- │ ├── ...

- │

- └── test...

- └── valid...

-

- voc_dataset/

- │

- ├── train/

- │ ├───├

- │ │ ├── image1.xml

- │ │ ├── image2.xml

- │ │ ├── ...

- │ │

- │ └───├

- │ ├── image1.jpg

- │ ├── image2.jpg

- │ ├── ...

- │

- └── test...

- └── valid...

三、模型训练

3.1理论技术

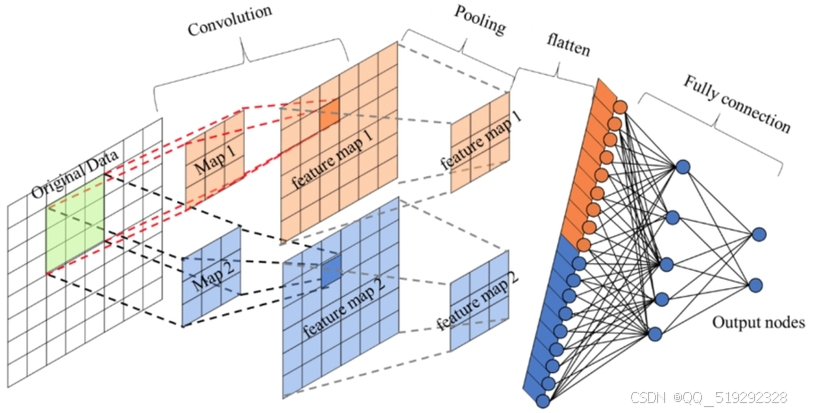

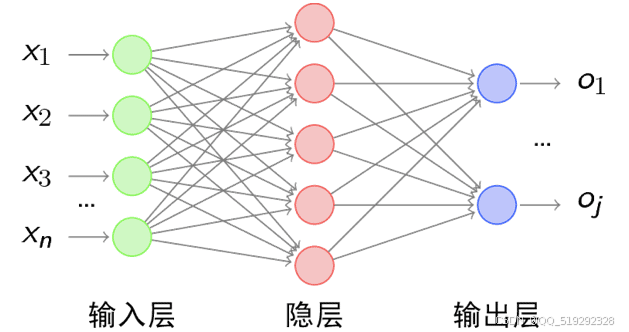

卷积神经网络(CNN)是一种专门为处理图像数据而设计的深度学习模型。其基本结构由多个卷积层、池化层和全连接层组成。卷积层通过卷积操作应用于输入图像,利用多个小的卷积核提取特征,这些卷积核能够学习图像中的空间特征。每个卷积层后通常配有激活函数(如ReLU),以引入非线性特性,使得模型能够学习到更复杂的特征。池化层则用于下采样,减少特征图的维度,从而降低计算量并提高模型的鲁棒性。通过这种层次化的结构,CNN能够逐层提取图像的高维特征,对于复杂的手机图像识别任务具有良好的适应性。

卷积神经网络在玩手机检测模型中的优势主要体现在其强大的特征提取能力和高效性。CNN能够通过层叠的卷积层自动提取图像的关键特征,而无需手动设计特征,这样可以减少人为偏差的风险。此外,由于手机的外观特征多样,CNN能够快速适应不同手机型号和颜色的变化,提高了检测的准确性和效率。通过训练,CNN能够学习到不同场景下手机的各种外观特征,使其在日常生活中的应用场景中表现出色。

YOLO采用单一的神经网络结构,将目标检测任务视为回归问题,能够在一次前向传播中同时进行目标的检测与分类。YOLO将输入图像划分为多个网格,每个网格负责检测特定区域内的目标物体,并同时预测边界框和类别概率。该算法通过对整个图像进行全局分析,能够在实时应用中实现高效的目标检测。此外,YOLO的改进版本引入了一些新的特性,如更深的网络结构、改进的损失函数和多尺度预测,以增强检测精度和速度。

YOLO算法在玩手机检测中的优势在于其高效性和实时性。通过对整张图像进行处理,YOLO能够快速检测并定位多个手机目标,适合于动态环境下的实时监控。对于不同类型的手机(如智能手机、功能手机等),YOLO能够迅速识别并准确框选,显著提高了检测效率。此外,改进的YOLO算法在处理复杂背景时表现优越,通过优化网络结构,使得模型在多种环境条件下仍然能够保持较高的准确性,从而有效降低误报和漏报的几率。

结合卷积神经网络(CNN)和改进的YOLO算法,我们可以构建一个新的玩手机检测模型。该模型首先利用CNN对输入的手机图像进行深度特征提取,生成高维特征图,然后将这些特征图输入到改进的YOLO算法中,进行目标的实时检测与分类。通过这种结合,模型能够充分利用CNN强大的特征提取能力,同时通过YOLO实现快速的目标检测。改进后的模型可以通过优化损失函数和增强数据增强手段,进一步提升检测精度和实时性,使其在日常生活的手机检测场景中表现优异。

3.2模型训练

确保计算环境中安装了Python及相关依赖。YOLOv5是一个流行的YOLO实现,使用Python编写并基于PyTorch框架。可以通过以下命令克隆YOLOv5的代码库并安装其依赖项:

- # 克隆YOLOv5的代码库

- git clone https://github.com/ultralytics/yolov5.git

- cd yolov5

-

- # 安装依赖

- pip install -r requirements.txt

2. 数据准备

数据准备包括将数据集划分为训练集和验证集,并确保标注格式符合YOLO要求。可以使用以下代码将图像和标签文件整理到合适的结构:

- import os

- import shutil

- import random

-

- # 定义数据集路径

- dataset_path = 'path/to/dataset'

- images_path = os.path.join(dataset_path, 'images')

- labels_path = os.path.join(dataset_path, 'labels')

-

- # 创建目标目录

- os.makedirs(images_path, exist_ok=True)

- os.makedirs(labels_path, exist_ok=True)

-

- # 假设原始数据在'original_data'文件夹中

- original_data_path = 'path/to/original_data'

-

- # 移动图像和标签文件

- for file in os.listdir(original_data_path):

- if file.endswith('.jpg') or file.endswith('.png'):

- shutil.move(os.path.join(original_data_path, file), images_path)

- elif file.endswith('.txt'):

- shutil.move(os.path.join(original_data_path, file), labels_path)

-

- # 划分数据集

- image_files = [f for f in os.listdir(images_path) if f.endswith(('.jpg', '.png'))]

- random.shuffle(image_files)

- train_size = int(0.8 * len(image_files))

-

- # 创建训练和验证文件夹

- train_images_path = os.path.join(dataset_path, 'train/images')

- val_images_path = os.path.join(dataset_path, 'val/images')

- os.makedirs(train_images_path, exist_ok=True)

- os.makedirs(val_images_path, exist_ok=True)

-

- # 移动文件

- for i, file in enumerate(image_files):

- if i < train_size:

- shutil.move(os.path.join(images_path, file), train_images_path)

- shutil.move(os.path.join(labels_path, file.replace('.jpg', '.txt').replace('.png', '.txt')), train_images_path)

- else:

- shutil.move(os.path.join(images_path, file), val_images_path)

- shutil.move(os.path.join(labels_path, file.replace('.jpg', '.txt').replace('.png', '.txt')), val_images_path)

3. 配置模型参数

创建一个配置文件以指定训练数据和类别信息,通常命名为data.yaml。示例内容如下:

- # data.yaml

- train: ./train/images

- val: ./val/images

-

- nc: 1 # 类别数量

- names: ['手机'] # 类别名称

4. 训练YOLO模型

使用以下命令启动训练,设置适当的超参数以优化模型性能:

- # 训练YOLO模型

- python train.py --img 640 --batch 16 --epochs 50 --data data.yaml --weights yolov5s.pt

5. 模型推断

训练完成后,可以使用训练得到的权重进行推断。以下代码示例展示如何进行推断并显示结果:

- import torch

-

- # 加载训练好的模型

- model = torch.hub.load('ultralytics/yolov5', 'custom', path='path/to/best.pt', force_reload=True)

-

- # 进行推断

- results = model('path/to/test/image.jpg')

-

- # 显示结果

- results.save() # 保存带有检测框的图像

- results.show() # 显示检测结果

四、总结

通过构建自制的数据集与深度学习算法模型,重点探讨了卷积神经网络和区域卷积神经网络的结合,提升手机检测的精度与效率。通过实验验证,模型在复杂背景下表现出良好的检测效果,具备较强的实际应用潜力。

QQ名片

QQ名片

评论记录:

回复评论: