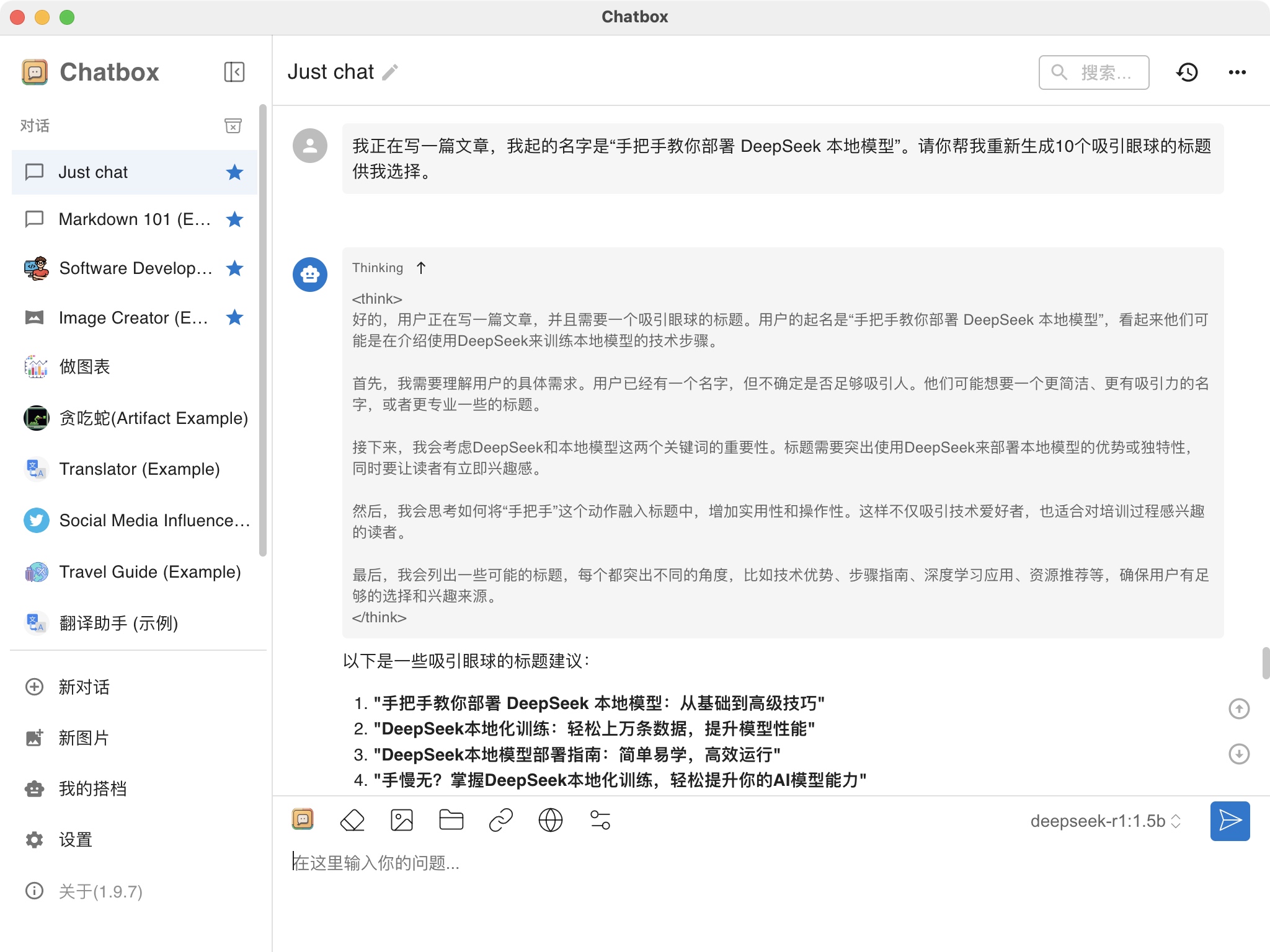

本指南将带你一步步完成 DeepSeek 本地模型的部署,同时结合 Ollama 提供 API 支持,并使用 Chatbox 作为 UI 界面,实现流畅的离线 AI 交互。

目标:简单易懂,让零基础用户也能顺利完成部署。

1. 安装 Ollama 并运行 DeepSeek

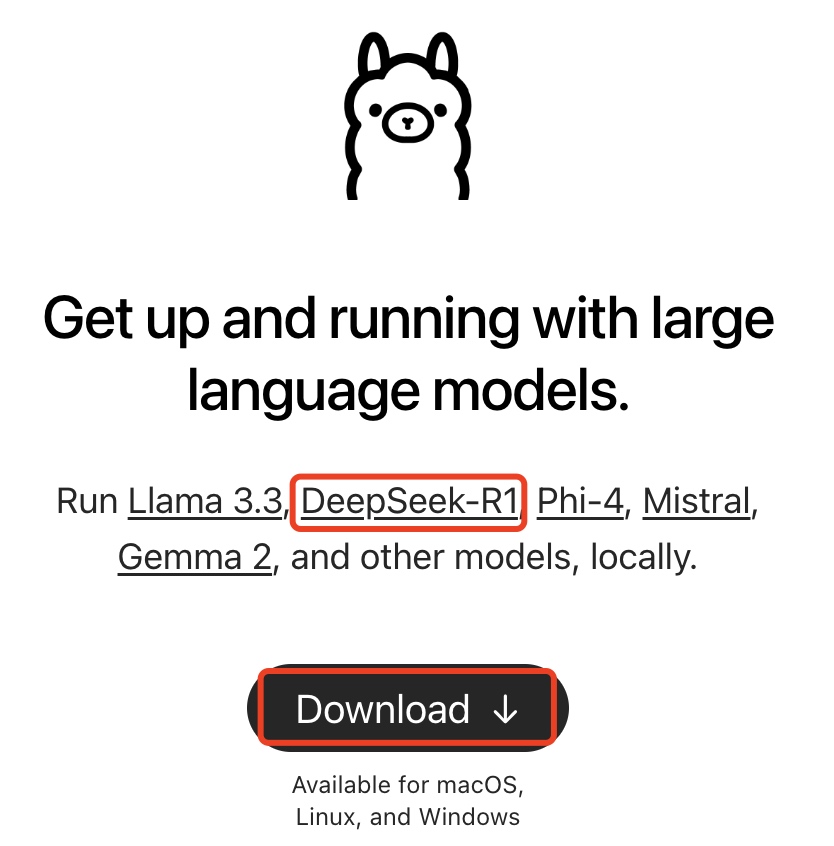

首先,从 Ollama 官方网站下载并安装 Ollama:

- 官网地址:https://ollama.com/

Ollama 现已支持 DeepSeek-R1 模型部署,进入官网后,你可以找到相关介绍:

点击 DeepSeek-R1 链接查看详情,目前 DeepSeek-R1 提供 1.5B、7B、8B、14B、32B、70B、671B 七种参数规模的模型。

由于我的设备性能有限,本次演示选择最小的 1.5B 版本:

选择建议:模型参数越大,效果越强,但对计算资源需求也更高,建议根据自身设备情况选择。

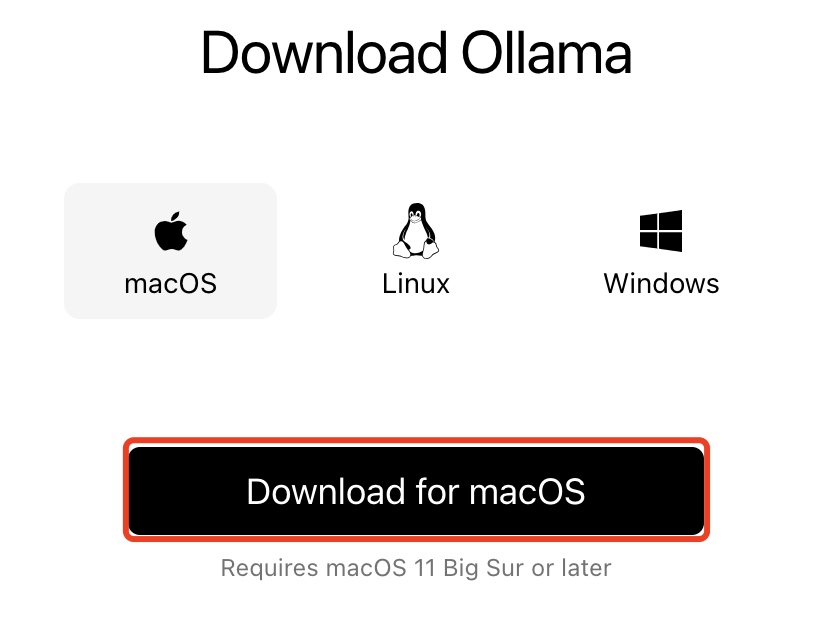

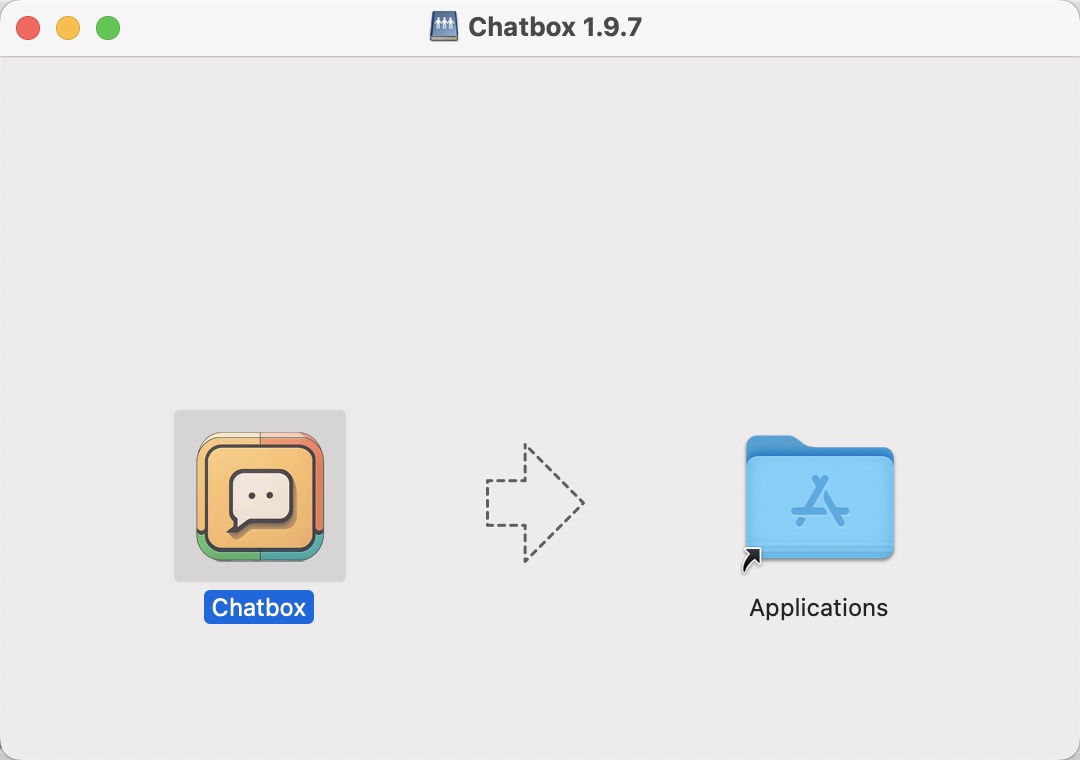

下载并安装 Ollama

在官网下载适用于自己操作系统的 Ollama:

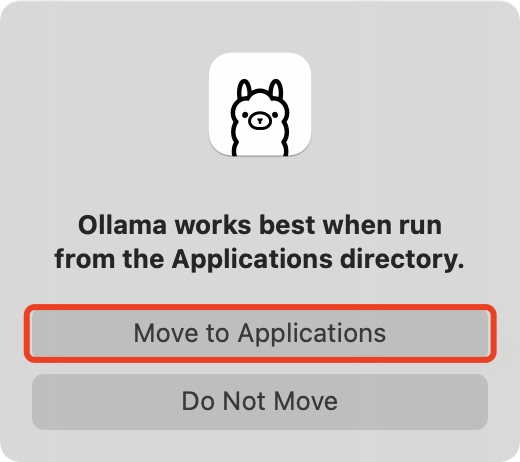

本文演示使用 macOS 版,下载后得到 Ollama-darwin.zip,解压后运行安装:

按照提示,点击 Install 进行安装:

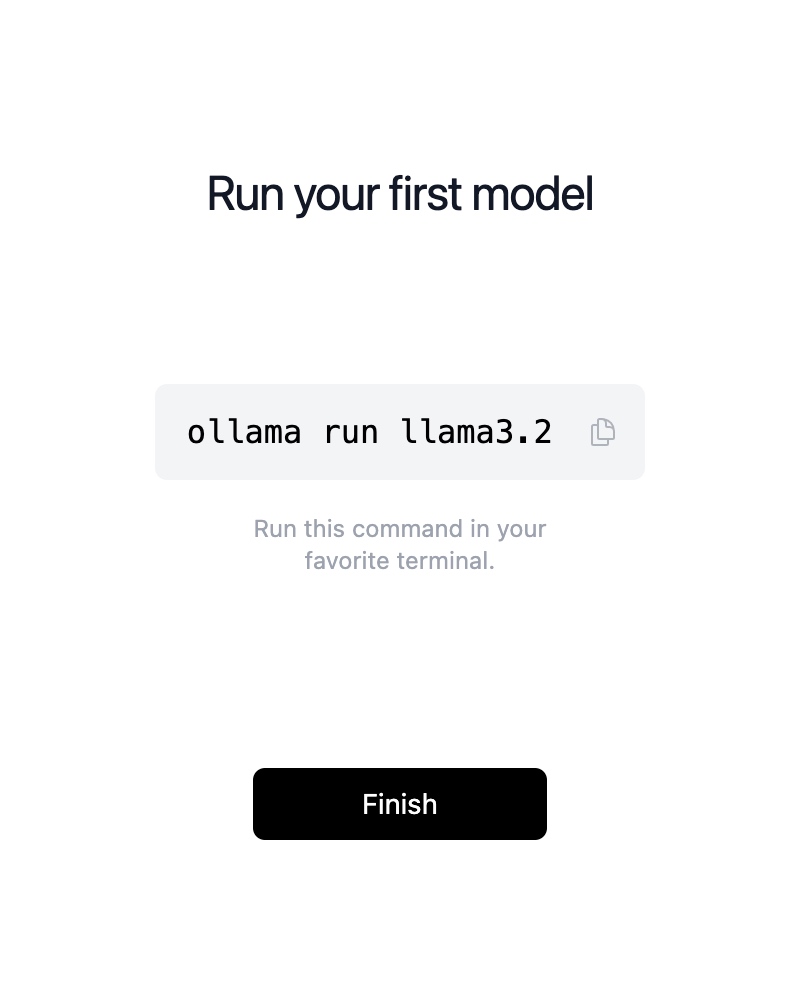

安装完成后,打开终端(Command + Space 搜索 terminal),执行以下命令下载并运行 DeepSeek 1.5B 模型:

ollama run deepseek-r1:1.5b

class="hljs-button signin active" data-title="登录复制" data-report-click="{"spm":"1001.2101.3001.4334"}">

class="blog_extension_card_cont">

class="blog_extension_card_cont_l">

class="blog_extension_card_cont">

class="blog_extension_card_cont_l">

评论记录:

回复评论: