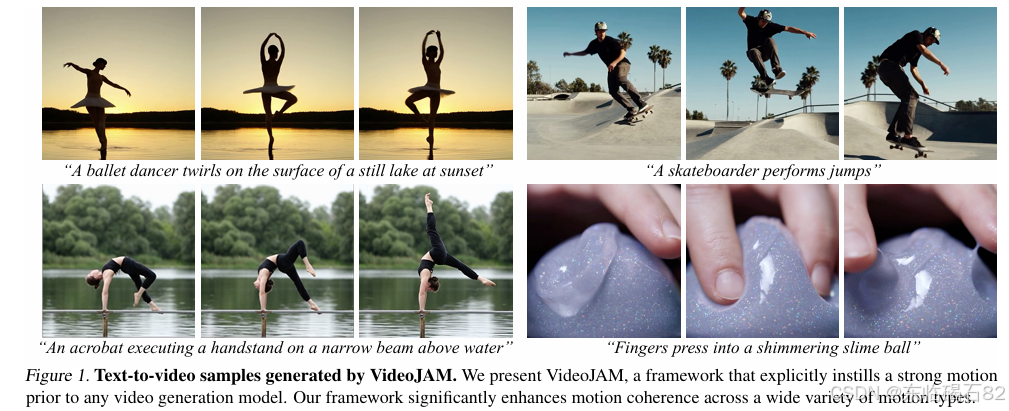

摘要:尽管近期取得了巨大进展,但生成式视频模型在捕捉真实世界的运动、动态和物理特性方面仍然面临挑战。我们发现,这一限制源于传统的像素重建目标,它使模型偏向于外观保真度,而牺牲了运动连贯性。为了解决这一问题,我们提出了VideoJAM,这是一个新颖的框架,通过在视频生成器中植入有效的运动先验,鼓励模型学习联合外观-运动表征。VideoJAM由两个互补的单元组成。在训练过程中,我们扩展了目标,以从单个学习到的表征中同时预测生成的像素及其对应的运动。在推理过程中,我们引入了Inner-Guidance机制,该机制利用模型自身不断演变的运动预测作为动态指导信号,引导生成过程朝向连贯的运动。值得注意的是,我们的框架可以应用于任何视频模型,只需进行极小的适应,无需修改训练数据或扩展模型规模。VideoJAM在运动连贯性方面取得了最先进的性能,超越了高度竞争性的专有模型,同时还提高了生成视频的感知视觉质量。这些发现强调,外观和运动可以是互补的,当它们有效结合时,可以增强视频生成的视觉质量和连贯性。项目网站:VideoJAM: Joint Appearance-Motion Representations for Enhanced Motion Generation in Video ModelsHuggingface链接:Paper page,论文链接:2502.02492

- 引言与背景:

- 生成式视频模型的挑战:尽管近期生成式视频模型在生成高质量视频片段方面取得了显著进展,但这些模型在捕捉真实世界的运动、动态和物理特性方面仍面临挑战。例如,当生成复杂的运动场景(如体操动作)时,生成的视频往往会出现严重的变形,甚至违反基本的物理定律。

- 像素重建目标的局限性:文章指出,这一限制主要源于传统的像素重建目标,它使模型偏向于关注外观保真度,而忽视了运动连贯性。具体来说,像素重建目标在比较模型预测与原始视频时,主要依据颜色、纹理等外观特征,而对动态和物理信息关注不足。

- VideoJAM框架的提出:为了解决上述问题,文章提出了VideoJAM框架,该框架通过向视频生成器中植入有效的运动先验,鼓励模型学习联合外观-运动表征,从而在生成视频时同时考虑外观和运动信息。

- VideoJAM框架概述:

- 框架组成:VideoJAM框架由两个互补的单元组成:训练单元和推理单元。

- 训练单元:在训练过程中,VideoJAM扩展了模型的目标,使其能够从单个学习到的表征中同时预测生成的像素及其对应的运动。为实现这一目标,文章对模型架构进行了修改,添加了两个线性层,一个用于将视频和运动信号嵌入到联合表征中,另一个用于从联合表征中提取运动预测。

- 推理单元:在推理过程中,VideoJAM引入了Inner-Guidance机制。该机制利用模型自身不断演变的运动预测作为动态指导信号,引导生成过程朝向连贯的运动。与现有的外部信号引导方法不同,Inner-Guidance机制不依赖于固定的外部信号,而是根据模型自身的预测进行动态调整。

- 实验与结果:

- 实验设置:文章在Diffusion Transformer(DiT)模型上进行了实验,选择了DiT-4B和DiT-30B两个变体,以展示VideoJAM在不同模型规模上的有效性。此外,文章还构建了VideoJAM-bench基准数据集,专门用于测试运动连贯性。

- 定性比较:文章展示了VideoJAM生成的视频样本,并与基线模型(如DiT-30B、Sora、Kling等)进行了比较。结果显示,VideoJAM生成的视频在运动连贯性方面表现更优,能够更好地捕捉复杂运动和物理特性。

- 定量比较:文章使用了自动评估指标(如VBench)和人类评估来定量比较不同模型的性能。结果显示,VideoJAM在运动连贯性方面取得了最先进的性能,超越了所有基线模型,包括高度竞争性的专有模型。同时,VideoJAM还提高了生成视频的感知视觉质量。

- VideoJAM的详细实现:

- 运动表示的选择:文章选择了光学流作为运动表示,因为它灵活、通用,且易于表示为RGB视频。光学流计算帧之间的密集位移场,能够捕捉视频中的运动信息。

- 模型架构的修改:为了实现联合外观-运动预测,文章对DiT模型的架构进行了修改。具体来说,文章添加了两个线性层,一个用于将视频和运动信号嵌入到联合表征中,另一个用于从联合表征中提取运动预测。

- 训练目标的扩展:在训练过程中,文章扩展了模型的目标函数,使其能够同时预测生成的像素及其对应的运动。通过最小化预测值与真实值之间的差异,模型能够学习到联合外观-运动表征。

- Inner-Guidance机制:

- 机制原理:Inner-Guidance机制利用模型自身不断演变的运动预测作为动态指导信号。在推理过程中,模型会根据自身的运动预测调整生成过程,从而引导生成的视频朝向连贯的运动。

- 与现有方法的比较:与现有的外部信号引导方法不同,Inner-Guidance机制不依赖于固定的外部信号。它根据模型自身的预测进行动态调整,因此能够更好地适应不同的视频生成任务。

- 实现细节:为了实现Inner-Guidance机制,文章对模型的采样分布进行了修改。通过引入运动预测作为条件信号,文章调整了采样分布的参数,使其能够引导生成过程朝向连贯的运动。

- VideoJAM的优势与应用:

- 通用性:VideoJAM框架可以应用于任何视频模型,只需进行极小的适应。它不需要修改训练数据或扩展模型规模,因此具有很高的通用性和实用性。

- 性能提升:实验结果显示,VideoJAM在运动连贯性方面取得了最先进的性能,同时提高了生成视频的感知视觉质量。这些发现强调了外观和运动信息的互补性,以及它们在视频生成中的重要性。

- 应用前景:VideoJAM框架在视频生成、视频编辑、虚拟现实等领域具有广泛的应用前景。通过提高生成视频的运动连贯性和视觉质量,它可以为这些领域带来更好的用户体验和更高的应用价值。

- 局限性与未来工作:

- 局限性:尽管VideoJAM框架在运动连贯性方面取得了显著进展,但它仍存在一些局限性。例如,在处理“缩放”场景(即运动物体占据帧的较小部分)时,VideoJAM的性能可能会下降。此外,由于运动表示缺乏明确的物理编码,VideoJAM在处理复杂物理交互时也可能表现不佳。

- 未来工作:针对上述局限性,未来的工作可以探索更先进的运动表示方法,以及如何将物理定律和动态特性更好地集成到视频生成模型中。此外,还可以进一步优化Inner-Guidance机制,以提高其在不同视频生成任务中的适应性和鲁棒性。

- 结论:

- 主要发现:文章提出了VideoJAM框架,通过向视频生成器中植入有效的运动先验,鼓励模型学习联合外观-运动表征。实验结果显示,VideoJAM在运动连贯性方面取得了最先进的性能,同时提高了生成视频的感知视觉质量。

- 研究意义:这些发现强调了外观和运动信息的互补性,以及它们在视频生成中的重要性。VideoJAM框架为视频生成领域提供了新的研究思路和方法,具有重要的理论意义和应用价值。

总结:

本文提出了VideoJAM框架,旨在解决生成式视频模型在捕捉真实世界运动、动态和物理特性方面的挑战。通过向视频生成器中植入有效的运动先验,鼓励模型学习联合外观-运动表征,VideoJAM在训练过程中扩展了预测目标,在推理过程中引入了Inner-Guidance机制。实验结果显示,VideoJAM在运动连贯性方面取得了最先进的性能,同时提高了生成视频的感知视觉质量。这些发现不仅为视频生成领域提供了新的研究思路和方法,还为虚拟现实、视频编辑等相关领域的发展提供了有力支持。未来工作可以进一步探索更先进的运动表示方法和优化Inner-Guidance机制,以提高VideoJAM在不同视频生成任务中的适应性和鲁棒性。

评论记录:

回复评论: