之前综合网络各方面信息得到的配置表:

之前综合网络各方面信息得到的配置表:

在信息爆炸的时代,数据安全和个性化需求愈发凸显。搭建本地私人知识库,不仅能确保数据的安全性,还能根据个人需求进行个性化定制,实现知识的高效管理和利用。随着技术的不断发展,我们现在有了更多强大的工具来实现这一目标。本文将详细介绍如何在 2025 年 2 月的 win11 系统环境下,利用 Ollama、Cherrystudio、beg - m3 和 Deepseek R1 32b 这些工具,部署属于自己的本地私人知识库。这些工具各自具有独特的优势,相互配合能够打造出一个功能强大、灵活高效的本地知识服务体系 ,满足大家在工作、学习和研究等多方面的知识管理需求。

部署前的准备

1. CPU(处理器)

型号建议:Intel Core i9-13600K/14600K

性能优势:均为高性能消费级CPU,具备强大的单核和多核处理能力,能够有效支持GPU的计算任务。

2. GPU(显卡)

型号建议:

消费级别可选:NVIDIA RTX 4090 或最低3090*1张 ,条件允许NVIDIA A100 或 H100(适合企业级应用)

考虑因素:若模型过于庞大,建议配置多台多块GPU并使用分布式训练技术。

3. 内存(RAM)

容量建议:最低48GB DDR5 6000起步

布局方式:采用双通道或四通道配置,提升内存带宽。

4. 存储(Storage)

系统盘建议:系统盘2TB PCI.E4.0容量起步,知识库存储SSD越大越好

数据存储扩展:可选NAS硬盘,提供大容量存储。

优点:NVMe SSD的高速读写适合快速加载模型和处理数据。

5. 电源(PSU)

功率建议:1250W以上,具体取决于GPU数量和类型

认证要求:选择80Plus金牌或白牌电源,确保高效稳定供电。

6. 散热系统

风冷散热器:NZXT Kraken X62 或Corsair Hydro H150i铂金版,支持高效散热。

机箱风扇:配置高质量机箱风扇,如Noctua NF-A12x25,提供良好的气流循环。

7. 网络(Networking)

网卡建议:Intel X550-T3 (千兆) 或更高如Mellanox ConnectX-6 for万兆网络

优点:高速网络接口便于数据传输和模型更新。

软件配置推荐

操作系统

首选系统:Ubuntu 22.04 LTS(支持长期维护,兼容性好)

备选方案:Windows 11 Pro for NVIDIA GPU管理

驱动与开发库

NVIDIA驱动:建议安装最新版本的CUDA-compatible驱动。

深度学习框架:

TensorFlow-GPU >=2.9.0

PyTorch >=2.0.0(支持MetaAI的新功能)

其他库:安装相应的PyPI依赖,如-transformers库等。

【0】能够流畅运行Deepseek R1 32b版本的机器 配置如下,实测低于这个配置则开始卡顿:

关键工具 Ollama 的安装与配置

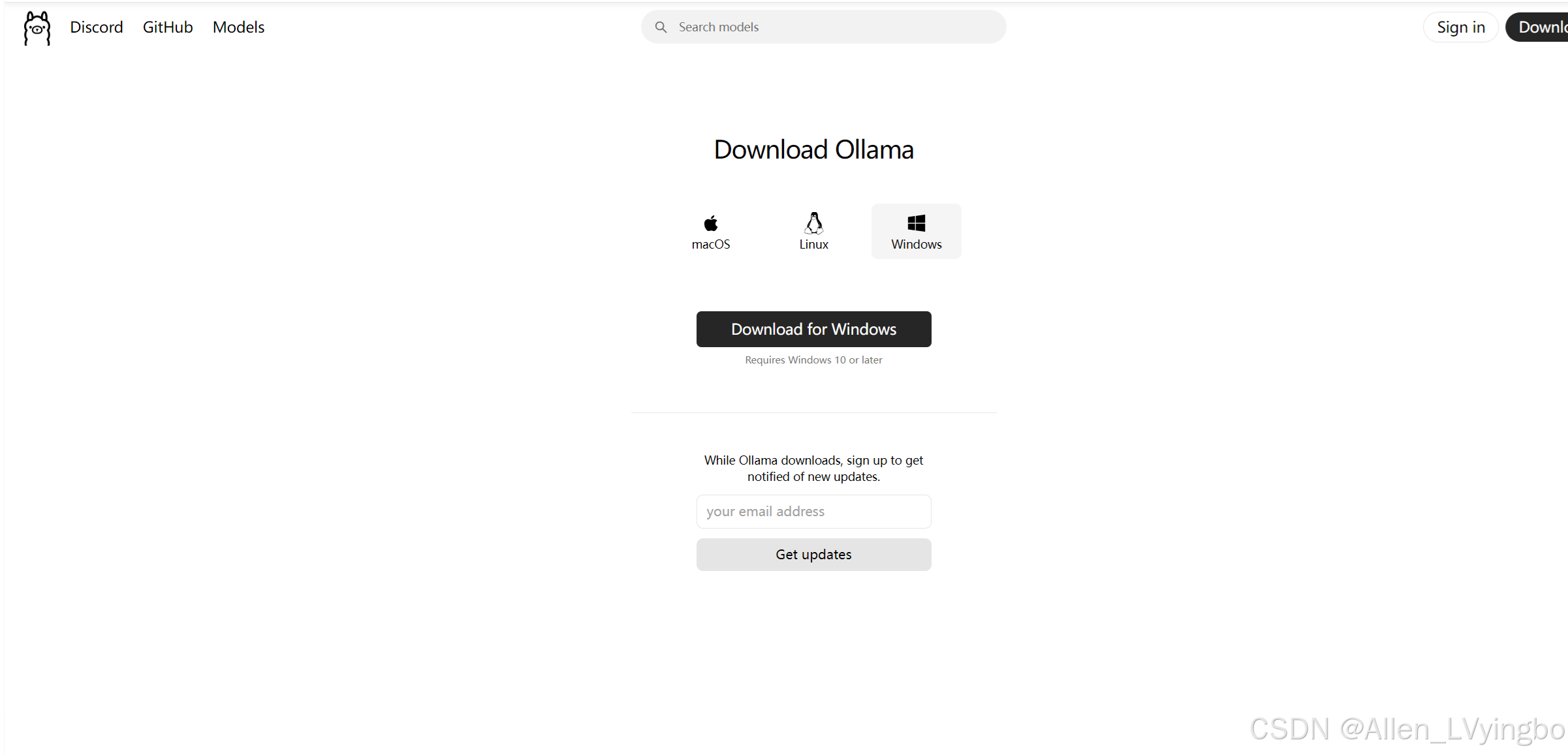

【1】下载Ollama:我们在win11 24H2系统下安装,注意选择 win版本Download Ollama on macOSDownload Ollama for macOS https://ollama.com/download

https://ollama.com/download

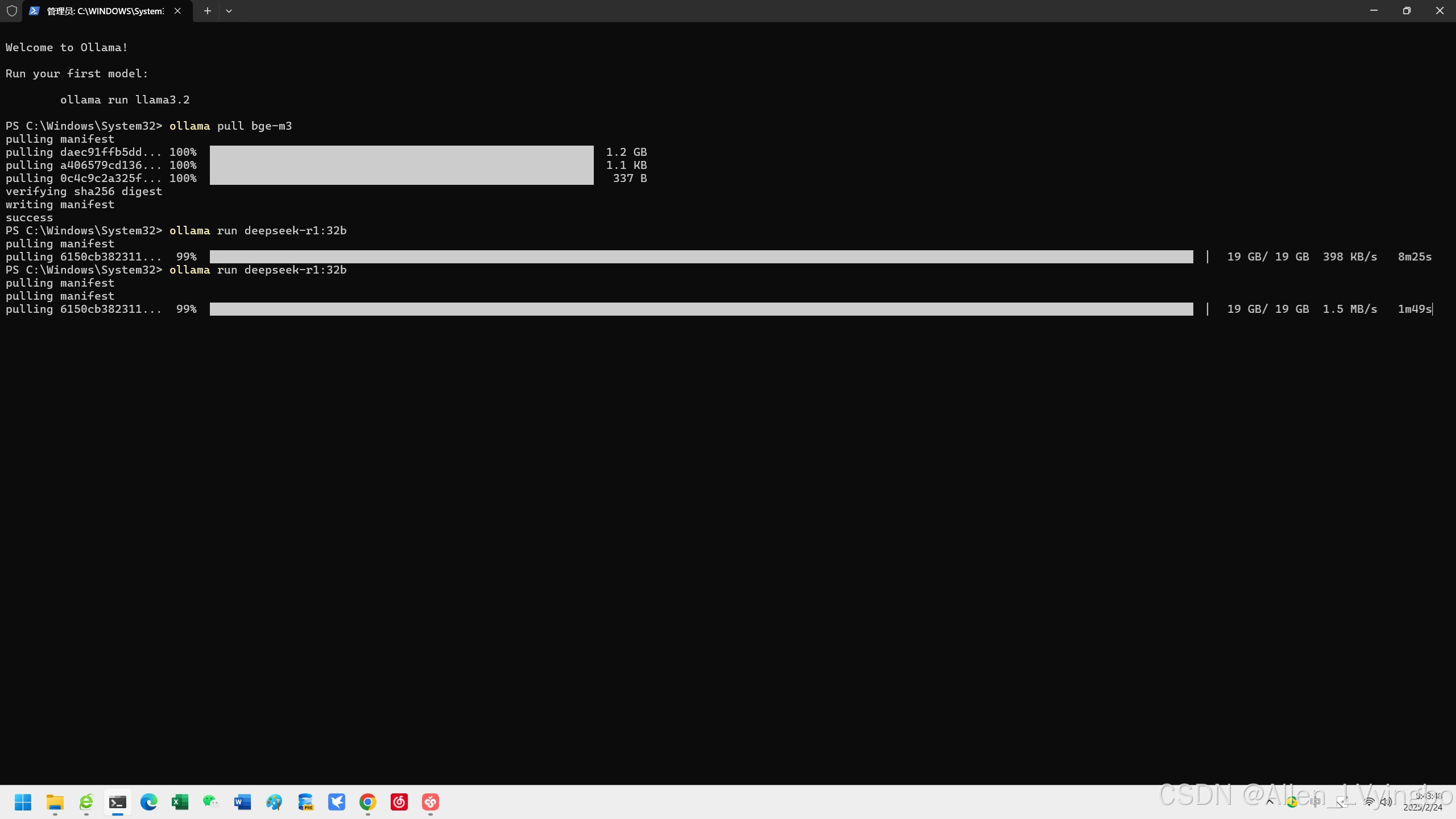

【2】一键式安装完成后,在终端里执行命令安装bgm-m3向量数据库和deepseek R1 32b版本:

【2】一键式安装完成后,在终端里执行命令安装bgm-m3向量数据库和deepseek R1 32b版本:

ollama pull bge-m3 class="hljs-button signin active" data-title="登录复制" data-report-click="{"spm":"1001.2101.3001.4334"}" onclick="hljs.signin(event)">

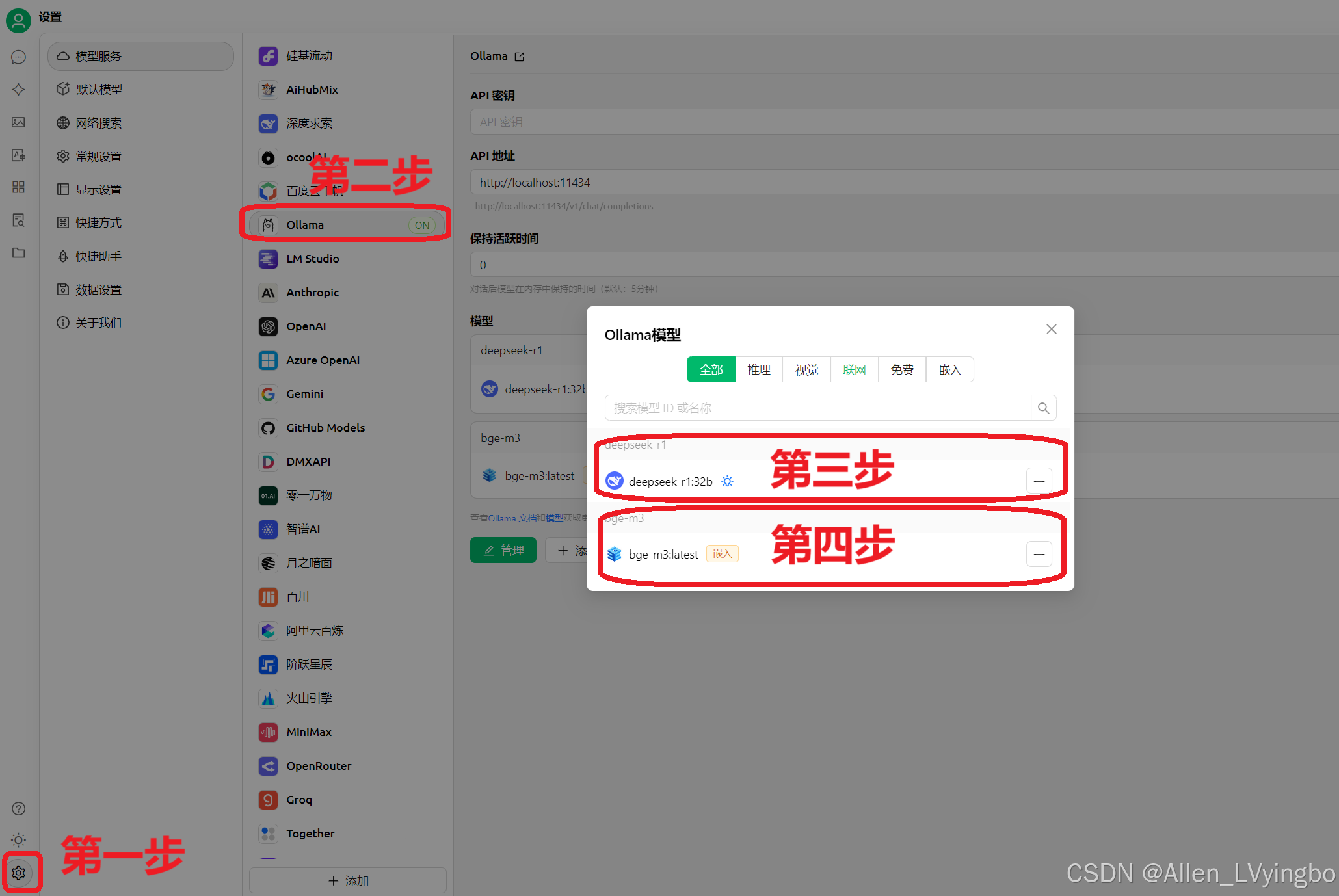

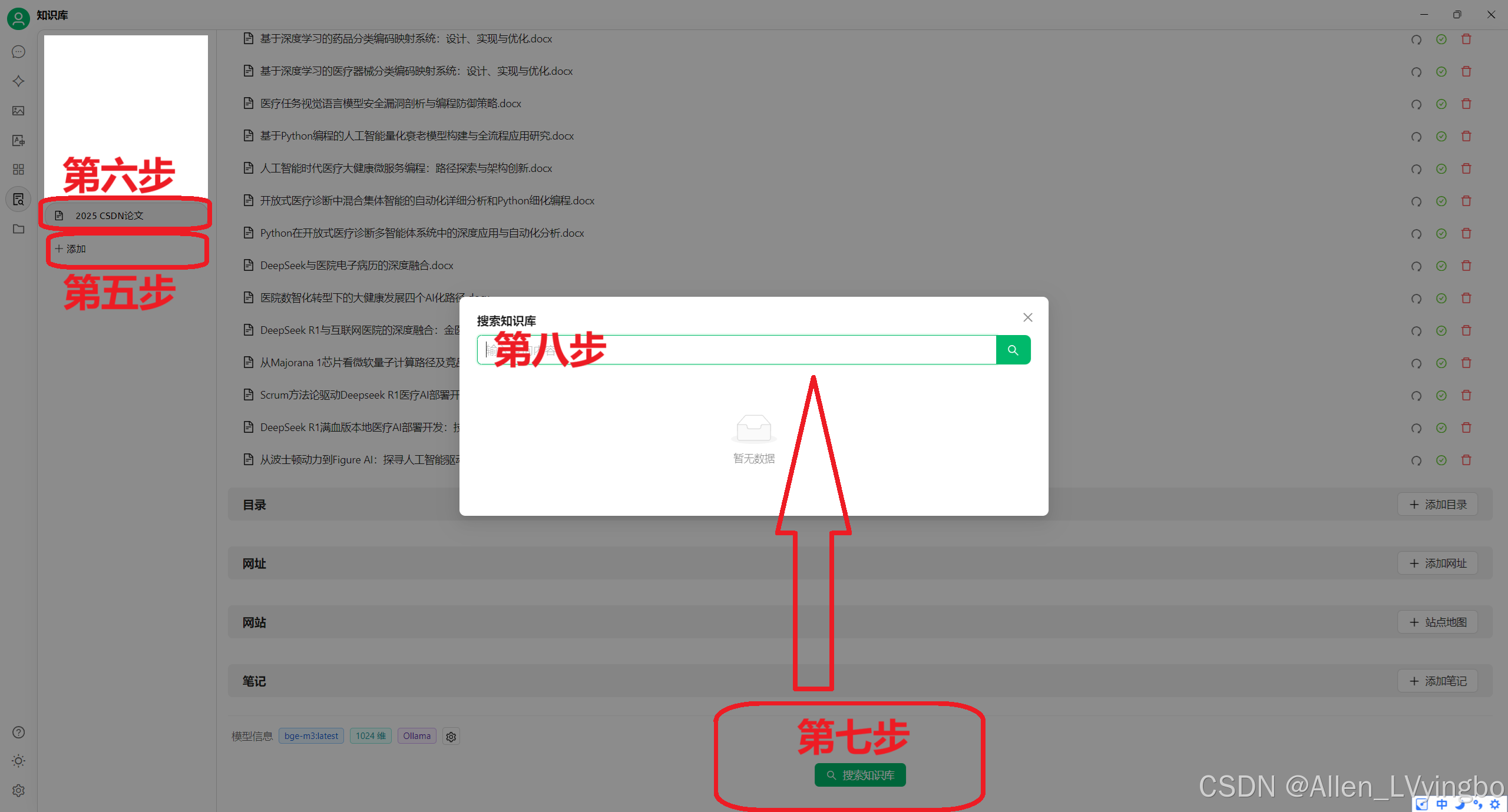

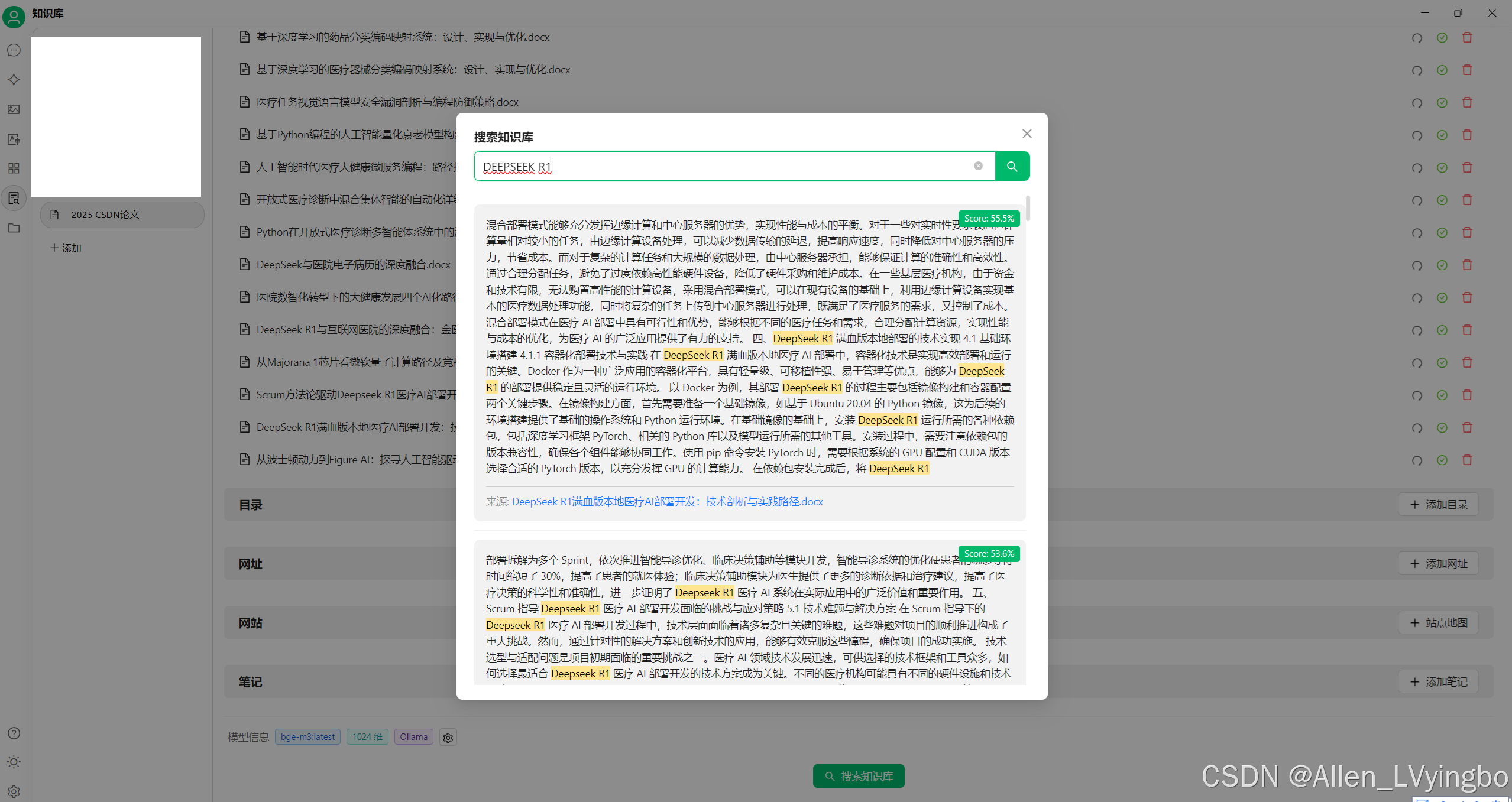

【5】维护知识库,第五步点击添加第六步输入标题,比如将我们今年写作的医疗开发方面文章以DOCX格式录入进去,第七步点击搜索知识库即可调出对话框搜索文章内的相关内容

【5】维护知识库,第五步点击添加第六步输入标题,比如将我们今年写作的医疗开发方面文章以DOCX格式录入进去,第七步点击搜索知识库即可调出对话框搜索文章内的相关内容

评论记录:

回复评论: