本文节选自电子工业出版社《自然语言处理实践:聊天机器人技术原理与应用》

作者:王昊奋&邵浩&李方圆&张凯&宋亚楠

以下是节选内容

按照技术实现,我们可将任务驱动的对话系统划分为如下两类:

模块化的对话系统

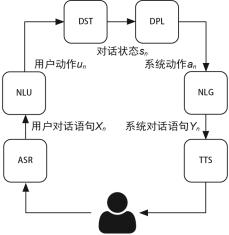

分模块串行处理对话任务,每一个模块负责特定的任务,并将结果传递给下一个模块,通常由NLU(Natural Language Understanding,自然语言理解)、DST(Dialogue State Tracking,对话状态追踪)、DPL(Dialogue Policy Learning,对话策略学习)、NLG(Natural Language Generation,自然语言生成)4个部分构成。在具体的实现上,可以针对任一模块采用基于规则的人工设计方式,或者基于数据驱动的模型方式。

端到端的对话系统

考虑采用由输入直接到输出的端到端对话系统,忽略中间过程,采用数据驱动的模型实现。

目前,主流的任务对话系统实现为模块化方式,由于现有训练数据规模的限制,端到端的方式仍处于探索阶段。本文主要介绍模块化的面向任务的对话系统,图1介绍了其主要模块。

(1)NLU:将用户输入的自然语言语句映射为机器可读的结构化语义表述,这种结构化语义一般由两部分构成,分别是用户意图(user intention)和槽值(slot-value)。

图1 面向任务的对话系统的主要模块

(2)DST:这一模块的目标是追踪用户需求并判断当前的对话状态。该模块以多轮对话历史、当前的用户动作为输入,通过总结和推理理解在上下文的环境下用户当前输入自然语言的具体含义。对于对话系统来说,这一模块有着重大意义,很多时候需要综合考虑用户的多轮输入才能让对话系统理解用户的真正需求。

(3)DPL:也被称为对话策略优化(optimization),根据当前的对话状态,对话策略决定下一步执行什么系统动作。系统行动与用户意图类似,也由意图和槽位构成。

(4)NLG:负责把对话策略模块选择的系统动作转化为自然语言,最终反馈给用户。

在与用户直接关联的两个模块中,ASR指的是自动语音识别,TTS指的是语音合成。如第2章介绍的,ASR和TTS并不是系统必备的模块,也不是本书介绍的重点,因此在面向任务的对话系统中不对这两部分技术做详细介绍。

1. NLU模块

本文主要结合NLU在面向任务的对话系统中的具体应用进行介绍。

对面向任务的对话系统来说,NLU模块的主要任务是将用户输入的自然语言映射为用户的意图和相应的槽位值。因此,在面向任务的对话系统中,NLU模块的输入是用户对话语句 ,输出是解析

,输出是解析 后得到的用户动作

后得到的用户动作 。该模块涉及的主要技术是意图识别和槽位填充,这两种技术分别对应用户动作的两项结构化参数,即意图和槽位。

。该模块涉及的主要技术是意图识别和槽位填充,这两种技术分别对应用户动作的两项结构化参数,即意图和槽位。

下面主要讨论如何针对面向任务的对话系统设计NLU模块,包括针对特定任务定义意图和相应的槽位,以及后续从用户的输入中获取任务目标的意图识别方法和对应的槽位填充方法。

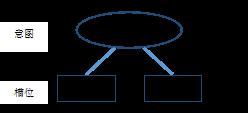

(1)意图和槽位的定义

意图和槽位共同构成了“用户动作”,机器是无法直接理解自然语言的,因此用户动作的作用便是将自然语言映射为机器能够理解的结构化语义表示。

意图识别,也被称为SUC(Spoken Utterance Classification),顾名思义,是将用户输入的自然语言会话进行划分,类别(classification)对应的就是用户意图。例如“今天天气如何”,其意图为“询问天气”。自然地,可以将意图识别看作一个典型的分类问题。意图的分类和定义可参考ISO-24617-2标准,其中共有56种详细的定义。面向任务的对话系统中的意图识别通常可以视为文本分类任务。同时,意图的定义与对话系统自身的定位和所具有的知识库有很大关系,即意图的定义具有非常强的领域相关性。

槽位,即意图所带的参数。一个意图可能对应若干个槽位,例如询问公交车路线时,需要给出出发地、目的地、时间等必要参数。以上参数即“询问公交车路线”这一意图对应的槽位。语义槽位填充任务的主要目标是在已知特定领域或特定意图的语义框架(semantic frame)的前提下,从输入语句中抽取该语义框架中预先定义好的语义槽的值。语义槽位填充任务可以转化为序列标注任务,即运用经典的IOB标记法,标记某一个词是某一语义槽的开始(begin)、延续(inside),或是非语义槽(outside)。

要使一个面向任务的对话系统能正常工作,首先要设计意图和槽位。意图和槽位能够让系统知道该执行哪项特定任务,并且给出执行该任务时需要的参数类型。为了方便与问答系统做异同对比,我们依然以一个具体的“询问天气”的需求为例,介绍面向任务的对话系统中对意图和槽位的设计。

用户输入示例:“今天上海天气怎么样”

用户意图定义:询问天气,Ask_Weather

槽位定义

槽位一:时间,Date

槽位二:地点,Location

“询问天气”的需求对应的意图和槽位如图2所示。

图2 意图与槽位定义(1)

在上述示例中,针对“询问天气”任务定义了两个必要的槽位,它们分别是“时间”和“地点”。

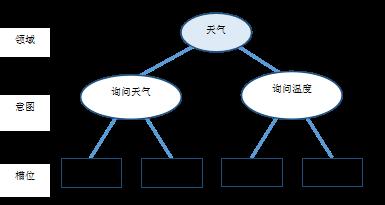

对于一个单一的任务,上述定义便可解决任务需求。但在真实的业务环境下,一个面向任务的对话系统往往需要能够同时处理若干个任务,例如气象台除了能够回答“询问天气”的问题,也应该能够回答“询问温度”的问题。

对于同一系统处理多种任务的复杂情况,一种优化的策略是定义更上层的领域,如将“询问天气”意图和“询问温度”意图均归属于“天气”领域。在这种情况下,可以简单地将领域理解为意图的集合。定义领域并先进行领域识别的优点是可以约束领域知识范围,减少后续意图识别和槽位填充的搜索空间。此外,对于每一个领域进行更深入的理解,利用好任务及领域相关的特定知识和特征,往往能够显著地提升NLU模块的效果。据此,对图2的示例进行改进,加入“天气”领域。

用户输入示例

1.“今天上海天气怎么样”

2.“上海现在气温多少度”

领域定义:天气,Weather

用户意图定义

1. 询问天气,Ask_Weather

2. 询问温度,Ask_Temperature

槽位定义

槽位一:时间,Date

槽位二:地点,Location

改进后的“询问天气”的需求对应的意图和槽位如图3所示。

图3 意图与槽位定义(2)

(2)意图识别和槽位填充

做好意图和槽位的定义后,需要从用户输入中提取用户意图和相应槽对应的槽值。意图识别的目标是从用户输入的语句中提取用户意图,单一任务可以简单地建模为一个二分类问题,如“询问天气”意图,在意图识别时可以被建模为“是询问天气”或者“不是询问天气”二分类问题。当涉及需要对话系统处理多种任务时,系统需要能够判别各个意图,在这种情况下,二分类问题就转化成了多分类问题。

槽位填充的任务是从自然语言中提取信息并填充到事先定义好的槽位中,例如在图2中已经定义好了意图和相应的槽位,对于用户输入“今天上海天气怎么样”系统应当能够提取出“今天”和“上海”并分别将其填充到“时间”和“地点”槽位。基于特征提取的传统机器学习模型已经在槽位填充任务上得到了广泛应用。近年来,随着深度学习技术在自然语言处理领域的发展,基于深度学习的方法也逐渐被应用于槽位填充任务。相比于传统的机器学习方法,深度学习模型能够自动学习输入数据的隐含特征。例如,将可以利用更多上下文特征的最大熵马尔可夫模型引入槽位填充的过程中[8],类似地,也有研究将条件随机场模型引入槽位填充。

基于RNN的深度学习模型在意图识别和槽位填充领域也得到了大量的应用,Attention-Based Recurrent Neural Network Models for Joint Intent Detection and Slot Filling中介绍了使用Attention-Based RNN模型进行意图识别和槽位填充的方法,作者提出将“alignment information”加入Encoder-Decoder模型,以及将“alignment information”和“attention”加入RNN这两种解决槽位填充和意图识别问题的模型。需要特别介绍的是,与基于RNN的意图识别和槽位填充相比,基于LSTM模型的槽位填充可以有效解决RNN模型中存在的梯度消失问题。

另外,在实际工程中往往需要先对句子中的各个组成部分进行标注,所以通常也会应用到序列标注方法。

进行意图识别和槽位填充的传统方法是使用串行执行的方式,即先进行意图识别,再根据意图识别的结果进行槽位填充任务。这种方式的主要缺陷是:

可能产生错误传递,导致错误放大。

限定领域也就意味着不同领域需要不同的方法和模型进行处理,各个领域之间的模型没有共享,但在很多情况下,例如订火车票和飞机票时,时间、地点等槽位都是一致的。

因为串行执行的方式存在上述问题,所以研究人员改为使用Multi-Domain Joint Semantic Frame Parsing Using Bi-Directional RNN-LSTM, INTERSPEECH中设计的联合学习(joint learning)方式进行意图识别和槽位填充。

另外,还有一种情况需要特别注意。在一次天气询问任务完成后,用户又问“那明天呢”时,实际上可以认为第二个问句是开始了另一次“询问天气”任务,只是其中的“时间”槽位是指定的,而“地点”槽位则需要重复利用(继承)上一次任务中的值。

对意图识别模块和槽位填充模块的主要评价指标包括:

意图识别的准确率,即分类的准确率。

槽位填充的F1-score。

2. DST模块

DST模块以当前的用户动作 、n-1前轮的对话状态和相应的系统动作作为输入,输出是DST模块判定得到的当前对话状态

、n-1前轮的对话状态和相应的系统动作作为输入,输出是DST模块判定得到的当前对话状态 。

。

对话状态的表示(DST-State Representation)通常由以下3部分构成。

(1)目前为止的槽位填充情况。

(2)本轮对话过程中的用户动作。

(3)对话历史。

其中,槽位的填充情况通常是最重要的状态表示指标。

我们知道,由于语音识别不准确或是自然语言本身存在歧义性等原因,NLU模块的识别结果往往与真实情况存在一定的误差。所以,NLU模块的输出往往是带概率的,即每一个可能的结果有一个相应的置信程度。由此,DST在判断当前的对话状态时就有了两种选择,这两种选择分别对应了两种不同的处理方式,一种是1-Best方式,另一种则是N-Best方式[11]。

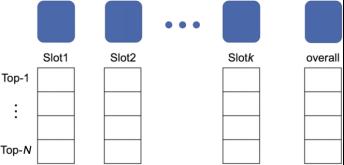

1-Best方式指DST判断当前对话状态时只考虑置信程度最高的情况,因此维护对话状态的表示时,只需要等同于槽位数量的空间,如图4所示。

图4 1-Best方式下的对话状态与槽位的对应

N-Best方式指DST判断当前对话状态时会综合考虑所有槽位的所有置信程度,因此每一个槽位的N-Best结果都需要考虑和维护,并且最终还需要维护一个槽位组合在一起(overall)的整体置信程度,将其作为最终的对话状态判断依据,如图5所示。

图5 N-Best方式下的对话状态与槽位的对应

实现DST模块的方法主要有:基于条件随机场模型的序列跟踪模型、基于RNN和LSTM的序列跟踪模型等。

3. DPL模块

DPL模块的输入是DST模块输出的当前对话状态 ,通过预设的对话策略,选择系统动作

,通过预设的对话策略,选择系统动作 作为输出。下面结合具体案例介绍基于规则的DPL方法,也就是通过人工设计有限状态自动机的方法实现DPL。

作为输出。下面结合具体案例介绍基于规则的DPL方法,也就是通过人工设计有限状态自动机的方法实现DPL。

案例一:询问天气

以有限状态自动机的方法进行规则的设计,有两种不同的方案:一种以点表示数据,以边表示操作;另一种以点表示操作,以边表示数据,这两种方案各有优点,在具体实现时可以根据实际情况进行选择。

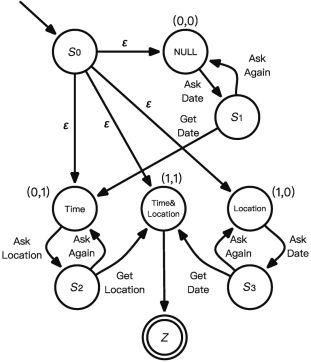

方案一:以点表示数据(槽位状态),以边表示操作(系统动作)(如图6所示)

在这种情况下,有限状态自动机中每一个对话状态S表示槽位的填充情况,例如槽位均为空时,状态为NULL,表示为(0,0);仅时间(Time)槽位被填充时,状态表示为(0,1)。本示例中槽位共有两个,分别为时间和地点(Location),因此共有4种不同的状态。

图6 “询问天气”有限状态自动机设计(1)

状态迁移是由系统动作引起的,例如仅时间槽位被填充时,下一步的系统动作为“询问地点”(Ask Location),以获取完整的槽位填充。S0为起始状态,Z为终结状态,S1、S2、S3三个状态的作用是对槽位填充进行确认。如果成功填充,则跳转到下一个状态继续;如果没有成功,则再一次询问进行槽位填充(Ask Again)。

这种方式的弊端非常明显:随着槽位数量的增加,对话状态的数量也会急剧增加。具体来说,在上述方案中,对话状态的总数由槽位的个数决定,如果槽位有k个,那么对话状态的数量为2k个。尝试改进这一弊端的研究有很多,如Young S等人提出的隐藏信息状态模型(Hidden Information State,HIS)和Thomson B等人提出的基于贝叶斯更新的对话状态管理模型(Bayesian Update of Dialogue State,BUDS)等。

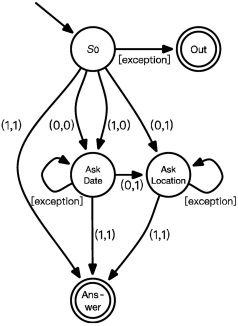

方案二:以点表示操作(系统动作),以边表示数据(槽位状态)(如图7所示)

图7 “询问天气”有限状态自动机设计(2)

在这种情况下,有限状态自动机中每一个对话状态S表示一种系统动作,本例中系统动作共有3种,分别是两种问询动作:“询问时间”(Ask Date)和“询问地点”(Ask Location),以及最后的系统回复“回答天气”(Answer)动作。有限状态自动机中状态的迁移则是由槽位的状态变化,即“用户动作”引起的。

对比上述两种方案可以发现,第二种有限状态自动机以系统动作为核心,设计方式更简洁,并且易于工程实现,更适合人工设计的方式。第一种有限状态自动机以槽位状态为核心,枚举所有槽位情况的做法过于复杂,更适合数据驱动的机器学习方式。

系统动作的定义通常有问询、确认和回答3种。问询的目的是了解必要槽位缺失的信息;确认是为了解决容错性问题,填槽之前向用户再次确认;回答则是最终回复,意味着任务和有限状态自动机工作的结束。

细心的读者可能已经发现,采取问询的方式获得缺失的槽位信息,在一些情况下是不合适的,以“询问天气”任务为例,向用户问询槽位缺失的信息会大幅降低用户对系统的满意度。在真实的业务环境下,系统往往会直接采取默认值填充槽位的方式,或者结合以往的对话历史数据,自动填补个性化的结果。例如,用户以往问的都是上海的天气,那么“地点”槽位就会被个性化地填充为“上海”。

这就引出了对面向任务的对话系统的质量评估方法:对面向任务的对话系统而言,完成用户指定任务所需的对话轮数越少越好。在实际应用中,诸如“询问天气”这样的任务,通常都尽可能地在一次对话中完成,而有些任务则必须要进行多轮对话,例如订餐、购票等任务。

接下来,我们以“订餐需求”为例,说明多轮对话的必要性,以及对话轮数的取舍问题。

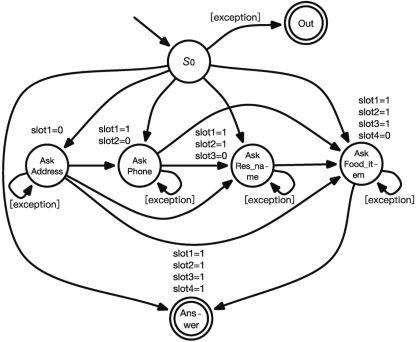

案例二:订餐

在典型的订餐领域的对话系统中,根据生活经验,我们知道需要为系统定义以下几个槽位。

(1)slot1:用户住址(Address)。

(2)slot2:用户手机号码(Phone)。

(3)slot3:订餐餐厅名称(Res_name)。

(4)slot4:食物名称(Food_item)。

(5)slot5:食物类型(Food_type)。

(6)slot6:价格范围(Price_range)。

其中前4项为必要槽位,对订餐任务来说是必须提供的参数,最后两项为非必要槽位,可有可无,有的话可以提高订餐任务的精准度。参考案例一的处理过程,首先对此任务设计相应的有限状态自动机,如图8所示。

图8 “订餐”系统有限状态自动机设计

可以发现,在该任务下的有限状态自动机设计中,我们只加入了必要槽位的问询操作,没有对Food_type和Price_range进行强制的系统问询。两个非必要槽位能够对“Ask Food_item”,即询问具体的食物名称起到辅助作用。当用户没有明确需求时,系统可以给出具体的食物推荐,这样的设定可以有效地减少非必要的对话,减少对话轮数。

4. NLG模块

NLG模块的输入是DPL模块输出的系统动作 ,输出是系统对用户输入

,输出是系统对用户输入 的回复

的回复 。

。

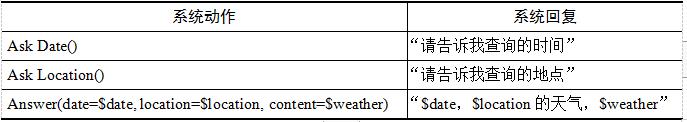

目前,NLG模块仍广泛采用传统的基于规则的方法,表1给出了3个示例规则的定义。根据规则可以将各个系统动作映射成自然语言表达。

为了实现回复的多样性,各种基于深度神经网络的模型方法被提出并得到发展。

以上是《自然语言处理实践:聊天机器人技术原理与应用》节选内容。

如果你想学习本书更多内容,识别下方二维码,即刻购书,可享 7.1 折优惠,限时哦~

另外,图书作者之一邵浩老师将于本周四晚8点(明晚)在AI科技大本营进行直播,演讲主题以及大纲请见下方海报。参与公开课,优秀提问者可获得《自然语言处理实践:聊天机器人技术原理与应用》一本。

点击阅读原文,也可以报名哦~

《VR 360°全景视频开发》专栏

将带你深入探索从全景视频制作到Unity眼镜端应用开发的全流程技术。专栏内容涵盖安卓原生VR播放器开发、Unity VR视频渲染与手势交互、360°全景视频制作与优化,以及高分辨率视频性能优化等实战技巧。

📝 希望通过这个专栏,帮助更多朋友进入VR 360°全景视频的世界!

Part 1 全景视频拍摄与制作基础

360°全景视频作为VR领域的重要组成部分,广泛应用于影视娱乐、教育培训、文化旅游、地产展示、医疗康复等多个行业。

本章主要梳理360°全景视频的理论基础、核心技术,以及典型应用场景,帮助大家从概念理解到应用场景有一个系统认知。

第一节|全景视频概述与应用场景

一、360°全景视频的基础理论

1.什么是360°全景视频?

360°全景视频是一种通过全景摄影机拍摄并拼接的视频形式,用户通过VR头显、手机或网页播放器,可以在视频场景中实现“环顾四周”,获得沉浸式体验。

2. 360°全景视频的特点

全视角沉浸体验

用户可自由环顾视频内的任意方向,带来身临其境的沉浸感,打破传统视频“被动观看”的限制。

- 结合

空间音频和全景画面,增强环境真实感,让用户仿佛置身拍摄现场。

交互性强

- 在VR眼镜端支持头部运动、手势、眼动等交互方式,实现视角切换、信息查看等互动操作,提升用户参与感。

高分辨率需求

- 为保证画质清晰度,通常采用8K甚至16K分辨率拍摄与播放,对设备性能和带宽提出更高要求。

拍摄与后期复杂

- 无论实拍和虚拍,都需要多镜头同步拍摄和高精度拼接处理,解决视差、缝隙和色彩统一等问题。

依赖播放器

- 需要播放器支持播放360°全景视频

- 最佳体验依赖VR头显,但也可通过手机、PC等设备实现基础观看功能。

3.全景视频与传统视频的区别

| 维度 | 传统视频 | 360°全景视频 |

|---|---|---|

| 视野 | 固定视角(导演控制) | 全方位视野(用户自由控制) |

| 设备 | 单镜头摄像机 | 多镜头全景相机或Rig |

| 后期 | 剪辑+调色 | 拼接+调色+空间音效 |

| 观看体验 | 被动观看 | 主动探索+沉浸式体验 |

4.两种全景视频映射方式

在全景视频的制作与播放中,如何将球形空间的全景影像映射到平面纹理,决定了视频的编码方式和播放性能。最常见的两种映射方式是等距圆柱投影和立方体贴图

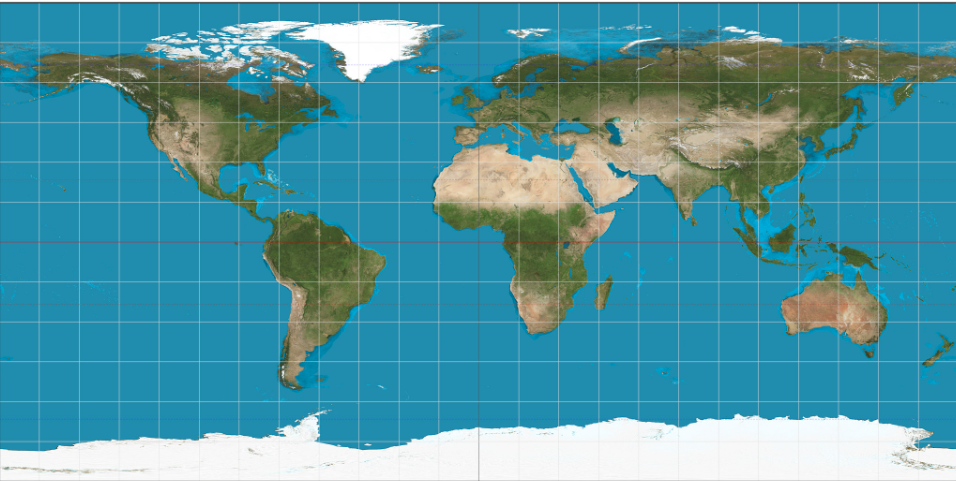

等距圆柱投影(Equirectangular Projection)

1. 定义

等距圆柱投影是一种将球面坐标系统映射到二维平面的方式,将球形图像展平为矩形图像。

通常,水平360°映射为图像的宽度,垂直180°(从北极到南极)映射为图像的高度。

下图来自https://docs-alpha.unity3d.com/cn/2022.1/Manual/VideoPanoramic.html

下图来自:等距圆柱投影 (equirectangular)

2. 显示效果

- 横向是360°完整水平视角

- 纵向是180°从天顶(上)到地面(下)

- 视觉上像是“地球仪被剥开铺平”的效果

- 图片比例通常为 2:1(例如:4096 x 2048 像素)

3. 优缺点

优点:

- 标准化强:大部分播放器和平台直接兼容

- 编辑方便:后期处理、视频拼接软件普遍支持

- 文件简单:只有一张图,便于存储和压缩

缺点:

- 极区变形严重:靠近天顶和地面的区域存在明显拉伸和压缩失真

- 像素利用率低:大量像素集中在用户较少观察的上下极区,浪费分辨率

- 性能压力大:高分辨率播放(如8K、16K)时对设备解码与渲染要求高

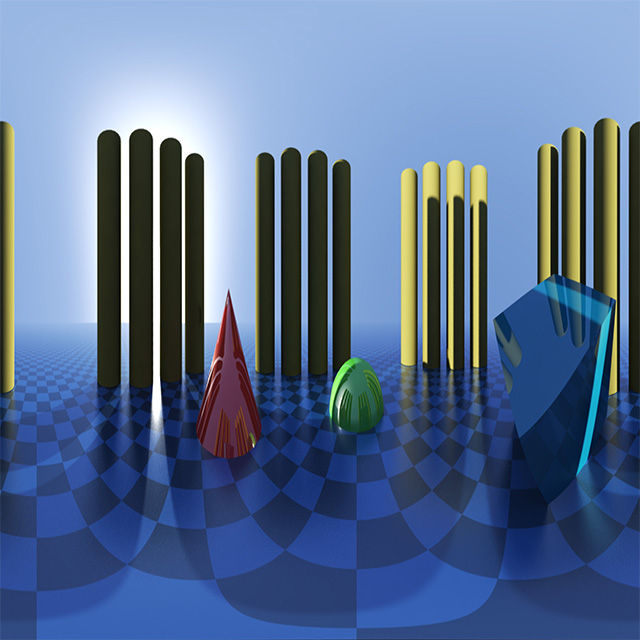

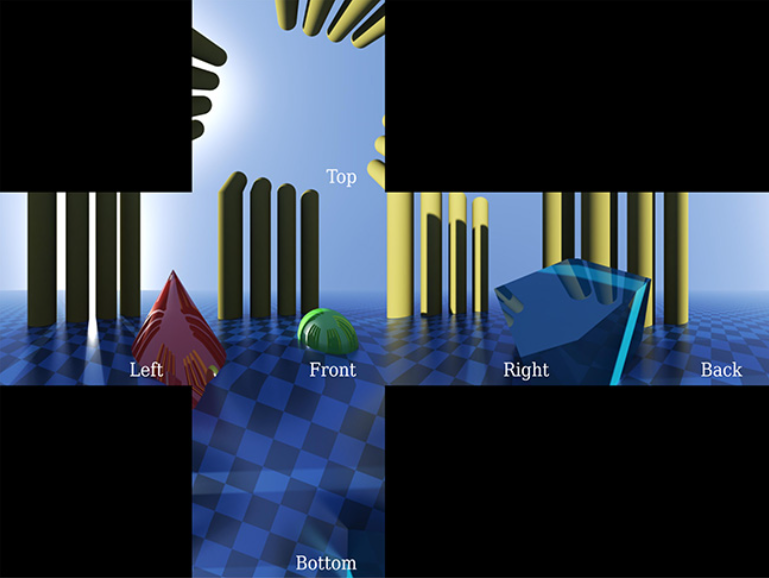

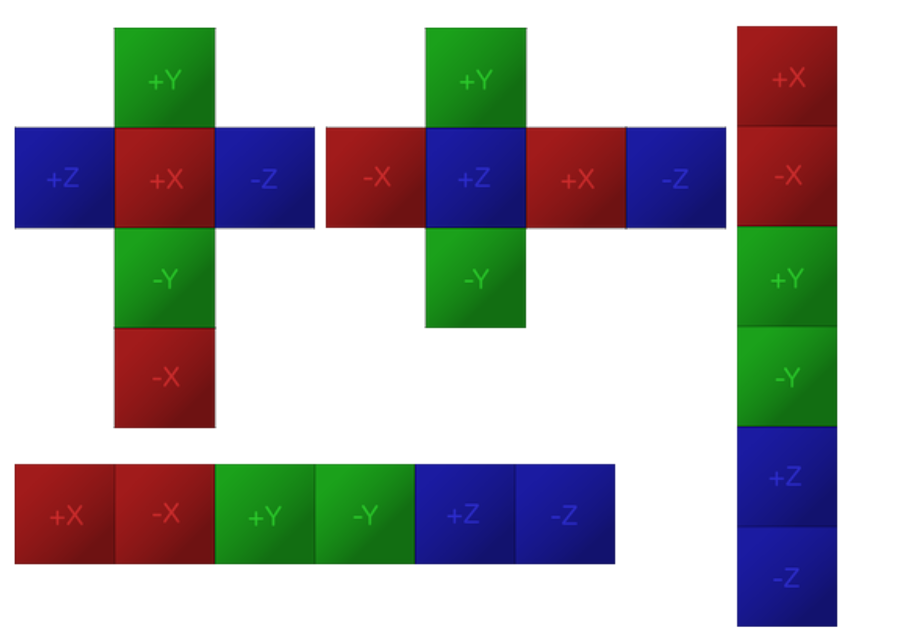

立方体贴图(Cubemap Projection)

1. 定义

立方体贴图将全景场景拆分为6个方向的图像,分别映射到一个立方体的6个面上(前、后、左、右、上、下),实现对整个环境的完整覆盖。

在渲染时,摄像机位于立方体内部,通过采样6个面的纹理来生成最终图像。

下图来自https://docs-alpha.unity3d.com/cn/2022.1/Manual/VideoPanoramic.html

2. 显示效果

- 每个面的视角是90°

- 通常输出为3x2或6x1图像排列,也可以拆成单独的6张图

例如:每个面2048x2048像素,整体图为6144x2048或12288x2048

3. 优缺点

优点

- 像素利用率高:避免极区拉伸,图像清晰度一致

- 更少畸变:在每个面内的图像变形控制良好,用户体验更佳

- 更低带宽:通常比等距圆柱投影的图像数据更高效

- 优化渲染:与GPU原生渲染方式更契合,性能更好

缺点

- 拼接复杂:需要处理6个面图像的接缝,尤其是动态视频时

- 编辑困难:后期合成、特效处理复杂度高

- 不统一标准:不同平台对Cubemap排列方式(横排/竖排/单独6图)支持不同,需要根据需求定制

二、360°全景视频应用场景

360°全景视频凭借沉浸式体验和交互性,已广泛应用于多个行业,为用户带来前所未有的体验方式和商业价值。

1.360°全景视频的典型应用场景

情况说明:

以下简单列举几个典型应用场景以及未来应用方向。由于素材将会来源网络,因此暂不附图说明。

文化旅游|沉浸式虚拟导览

利用全景视频和VR技术,打造虚拟景区导览,让游客足不出户就能“身临其境”地游览名胜古迹、博物馆或历史遗迹。通过VR头显或手机应用,用户可自由切换视角,欣赏景区美景,获得互动讲解。

- 智慧文旅平台:多个景区上线VR导览功能,提升游客决策和体验感。

教育培训|高效沉浸教学

360°全景视频为教育培训行业带来了沉浸式学习体验,尤其在远程教学、职业培训和仿真演练中应用广泛。

房地产|VR看房与沉浸营销

通过全景视频结合VR技术,打造线上看房平台和样板间展示系统,突破时间和空间限制,让客户随时随地看房。

- VR看房

案例:贝壳VR看房平台,采用全景视频与三维建模结合,实现线上样板间展示。用户可通过VR头显或手机APP随时查看房型结构和装修细节。 - 营销展示

案例:VR样板房体验,展示楼盘景观与配套设施,辅助销售人员进行沉浸式讲解。

娱乐与直播|沉浸式演唱会与赛事观赛

全景视频已成为VR娱乐和直播的重要内容形式,广泛应用于演唱会、体育赛事、电影等领域。

-

VR演唱会

通过多机位360°视频和空间音效录制,观众佩戴VR头显后,仿佛站在舞台最前排,实时观看偶像表演。 -

视频直播

Pico视频、爱奇艺VR等平台都提供了360视频直播,使得用户可以有更好的直播体验。

企业营销与品牌传播|全景视频赋能营销新体验

品牌通过360°视频进行沉浸式营销展示,提升用户品牌感知和参与度。

-

汽车行业

车企发布VR试驾体验视频,用户通过VR设备体验不同路况下的驾驶感受。 -

时尚发布会

品牌通过360°视频直播新品发布,观众仿佛亲临T台现场,体验潮流动态。

2.VR大空间技术中的全景视频应用与资源优化

在VR大空间应用中,用户可以在数百甚至上千平方米的物理空间内自由移动,体验高度沉浸式的虚拟环境。为保证场景细节丰富、运行流畅,资源优化至关重要。而360°全景视频在这里扮演了重要角色。

360°全景视频作为场景背景资源

在VR大空间项目中,部分场景采用高分辨率全景视频替代3D建模和实时渲染,可以显著降低系统计算压力。比如远景、天空、城市街区等静态或半静态环境,通过360°视频实现视觉还原,不仅保真度高,还能减少GPU实时渲染负载。

降低渲染开销,提高帧率

全景视频素材在播放过程中,只需在球形或立方体贴图上做解码和贴图处理,相比完全使用3D模型渲染和光照计算,占用的GPU资源大幅降低。这种优化能够确保VR大空间系统在高帧率(如90FPS以上)下平稳运行,提升用户的运动舒适性,减少眩晕感。

全景视频与互动内容结合

在大空间VR体验中,可以将360°全景视频与实时互动内容(如3D交互对象、手势操作、多人联机)融合,丰富场景内容的同时,避免资源过载。比如用户在全景视频搭建的场景中行走探索,遇到交互点后再加载精细化的3D模型或触发互动事件。

三、360°全景视频发展现状与挑战

1. 发展现状

- 拍摄设备不断优化

Insta360、GoPro、Kandao等品牌不断推出更高分辨率、操作简便的全景相机,如Insta360 Titan(11K)、Kandao Obsidian(8K) - 播放器与平台丰富

对于开发者,Unity、Unreal支持原生360°视频播放。对于普通用户,Window系统视频播放器、哔哩哔哩、YouTube、Facebook等也都已支持全景视频播放(VR模式)。 - XR硬件普及Meta Quest、Pico、HTC Vive等设备降低了VR硬件的门槛。

2. 当前技术挑战

| 挑战点 | 说明 |

|---|---|

| 高分辨率解码 | 播放8K、16K视频需高性能硬件,移动端优化困难 |

| 带宽与存储压力 | 超高清视频文件体积大,传输与播放延迟大 |

| 拼接缝合算法 | 多镜头拼接存在色差、缝隙、运动伪影等问题 |

| 用户交互匮乏 | 仅靠观看缺乏互动体验,需手势、语音等增强互动 |

四、全景视频的未来趋势

1. 分辨率和帧率进一步提升

- 16K、32K超高清视频逐步成为高端VR项目标配

- 高帧率(60FPS+)增强运动场景流畅性

2. AI拼接与渲染

- AI图像增强与自动拼接技术,降低后期成本,提升画质

- AI对象移除,解决拍摄设备或操作人员入镜问题

3. 增强交互体验

- 手势识别、眼动追踪、注视点交互等提升用户沉浸感

- 未来支持与数字人、虚拟导游结合,实现个性化互动

结语

本专栏旨在系统地分享VR 360°全景视频的开发全流程。包括但不限于全景视频的拍摄与制作、安卓原生VR播放器的开发、以及如何在VR眼镜上实现全景视频播放器。

✅ 如果你对VR开发感兴趣,欢迎关注本专栏!

💬 有任何问题或想了解的内容,欢迎留言讨论,一起探索XR技术的更多可能!

👉 更新详情

【Part 1全景视频拍摄与制作基础】

- 第一节|全景视频概述与应用场景(2025年3月23日12:00更新)

QQ名片

QQ名片

评论记录:

回复评论: